Оглавление:

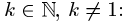

Математической статистикой называется раздел математики, занимающийся разработкой методов получения, описания и обработки опытных данных с целью выявления и изучения закономерностей случайных массовых явлений для научных и практических выводов.

| Если что-то непонятно — вы всегда можете написать мне в WhatsApp и я вам помогу! |

Математическая статистика

Математическая статистика — это наука, посвященная разработке оптимального вывода, основанного на неизвестных закономерностях.

Напомним некоторые основные определения из курса теории вероятностей.

Возможно эта страница вам будет полезна:

| Предмет теория вероятностей и математическая статистика |

Определение. Пространством элементарных событий называется множество исходов некоторого эксперимента. Элементарным событием называется любой элемент пространства элементарных событий. Событием называется любое подмножество пространства элементарных событий. Экспериментом называется функция, принимающая значение на пространстве элементарных событий.

Определение. Генеральной совокупностью называется достаточно большое, быть может, бесконечное подмножество элементарных событий.

Определение. Случайной величиной называют функцию от элементарного события.

Модель конечного случайного выбора

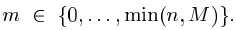

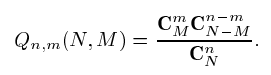

Рассмотрим модель «Выбор без возвращения». Пусть N — общее число элементов генеральной совокупности, М — число отмеченных (каким-то свойством) элементов, те — размер выборки, т. е. число элементов, выбранных из генеральной совокупности, то — число отмеченных элементов в выборке.

Вероятностная задача рассматривает случай, когда те, М и N заданы, а то  Тогда вероятность того, что среди выборки размера те окажется ровно то отмеченных элементов, может быть вычислена по известной формуле

Тогда вероятность того, что среди выборки размера те окажется ровно то отмеченных элементов, может быть вычислена по известной формуле

Статистическая задача ставится несколько иначе. Например:

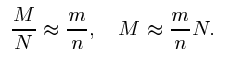

а) Допустим, что n, m, N известны, а М — неизвестно. Требуется оценить М. Это в некотором смысле задача, обратная вероятностной. Решить ее не так-то просто. Простейшее (но довольно грубое) приближение для М можно найти, например, из соотношений

Для того, чтобы найти более точные оценки, нужны специальные методы, которыми и занимается математическая статистика.

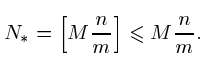

б) Пусть заданы n, m, и М, а N неизвестно. Требуется оценить N. Пример такой задачи — оценка числа рыб в водоеме: производится выборка размера М, помечаются все рыбы из этой выборки, а спустя некоторое время производится еще одна выборка размера n и подсчитывается число помеченных рыб то из этой выборки. По этим данным требуется оценить число рыб в водоеме. Для решения jiTofi задачи рассматривается вероятность  как функция переменной N. Оказывается, что функция

как функция переменной N. Оказывается, что функция  сначала возрастает, а затем убывает. В качестве оценки искомого значения N выбирается такое целое

сначала возрастает, а затем убывает. В качестве оценки искомого значения N выбирается такое целое  , для которого

, для которого  максимально. Можно показать, что

максимально. Можно показать, что

Рассмотрим следующий эксперимент: два раза независимо друг от друга бросается монетка. Можно рассматривать две модели этого эксперимента:

1) 4 исхода: выпали последовательно орел-орел, орел-решка, решка-орел, решка-решка. Каждому исходу приписывается вероятность 1/4.

2) 3 исхода: 2 орла, 2 решки, 1 орел и 1 решка; каждому исходу приписывается вероятность 1/3

Практика показывает, что первая модель более соответствует действительности, чем вторая: при большом числе испытаний каждый из четырех исходов появляется с частотой, близкой к 1/4 , в то время как во второй модели последний исход появляется с частотой, близкой к 1/2, а первые два — с частотой 1/4 , что плохо соответствует приписанным вероятностям.

В некотором смысле задача математической статистики обратна задаче теории вероятностей. В теории вероятностей в каждой конкретной ситуации вероятность считается полностью определенной и основной задачей теории вероятностей является разработка методов нахождения вероятностей различных сложных событий (исходя из известных вероятностей более простых событий) для данной вероятностной модели.

В математической статистике рассматривается статистическая модель, которая описывает такие ситуации, когда в вероятностной модели изучаемого эксперимента имеется та или иная неопределенность в задании вероятности, и задача математической статистики состоит в том, чтобы уменьшить эту неопределенность, уточнить (выявить) структуру статистической модели по результатам проводимых наблюдений.

Статистическая модель схемы Бернулли

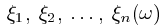

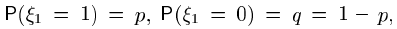

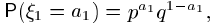

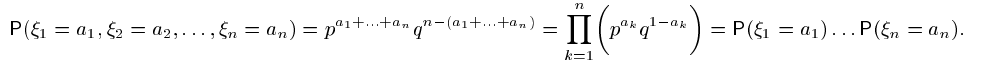

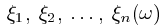

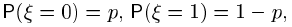

Зафиксируем число  Рассмотрим случайные величины

Рассмотрим случайные величины  на некотором общем вероятностном пространстве

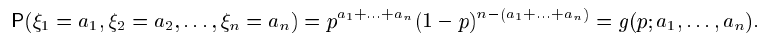

на некотором общем вероятностном пространстве  Их совместное распределение:

Их совместное распределение:

Значение случайной величины  — исход первого испытания,

— исход первого испытания,  и аналогично для

и аналогично для Отсюда

Отсюда  и т.д. Значит,

и т.д. Значит,

Отсюда следует, что  — независимые испытания.

— независимые испытания.

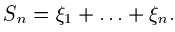

Рассмотрим случайную величину  Она имеет биномиальное распределение:

Она имеет биномиальное распределение:

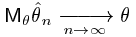

Задача математической статистики — оценить неизвестное значение р. Для этого используются три подхода — точечная оценка, интервальная оценка и выбор из двух гипотез. Продемонстрируем каждый из них на примере схемы Бернулли.

Точечная оценка

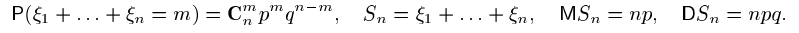

Запишем закон больших чисел для схемы Бернулли:

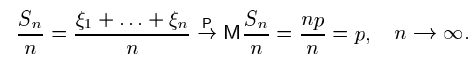

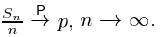

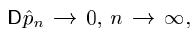

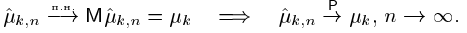

т. е. частота появления успешного исхода  сходится по вероятности к параметру р:

сходится по вероятности к параметру р:

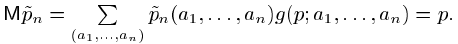

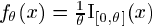

Возьмем в качестве оценки параметра р эту частоту  Это случайная величина со значениями

Это случайная величина со значениями

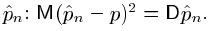

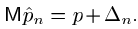

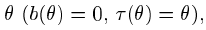

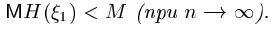

Теорема 1.1. Эта оценка обладает следующими свойствами:

1) Несмещенность:

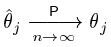

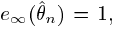

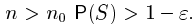

2) Состоятельность:

3) Эффективность: Дисперсия частоты  является наименьшей среди дисперсий всех других оценок, которые обладают свойствами 1) и 2).

является наименьшей среди дисперсий всех других оценок, которые обладают свойствами 1) и 2).

□ Выше уже было показано, что оценка  несмещенная (это следует из того, что

несмещенная (это следует из того, что  , а в силу закона больших чисел для схемы Бернулли она состоятельна; тем самым свойства 1) и 2) доказаны.

, а в силу закона больших чисел для схемы Бернулли она состоятельна; тем самым свойства 1) и 2) доказаны.

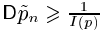

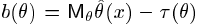

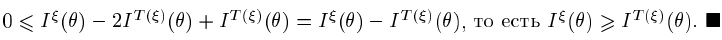

Докажем свойство 3) — эффективность. Пусть  — любая оценка параметра р, удовлетворяющая условиям 1) и 2) (несмещенность и состоятельность). Рассмотрим величину

— любая оценка параметра р, удовлетворяющая условиям 1) и 2) (несмещенность и состоятельность). Рассмотрим величину  . Она называется средней квадратической ошибкой оценки

. Она называется средней квадратической ошибкой оценки  .

.

Для несмещенных оценок средняя квадратическая ошибка совпадает с дисперсией, в частности для нашей оценки

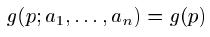

Обозначим

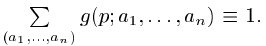

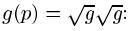

Для любого  имеет место равенство

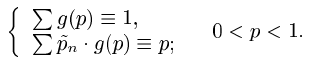

имеет место равенство  Условие несмещенности оценки означает, что

Условие несмещенности оценки означает, что  Рассмотрим

Рассмотрим  как функцию параметра р. Тогда наши условия могут быть записаны в следующем виде (суммирование ведется по всем наборам

как функцию параметра р. Тогда наши условия могут быть записаны в следующем виде (суммирование ведется по всем наборам  :

:

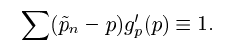

Продифференцируем каждое из этих соотношений по р, а затем, умножив первое нар, вычтем его из второго; получим:

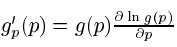

Теперь представим  как логарифмическую производную:

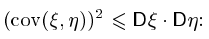

как логарифмическую производную:  затем применим неравенство Коши-Буняковского, представив

затем применим неравенство Коши-Буняковского, представив  в виде

в виде

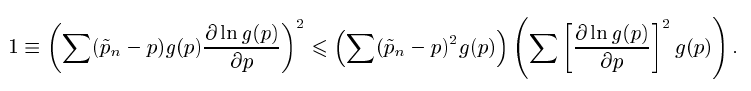

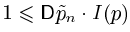

Так как  (условие несмещённости оценки

(условие несмещённости оценки  ), то первый из множителей в правой части этого неравенства — это дисперсия

), то первый из множителей в правой части этого неравенства — это дисперсия  . Обозначим второй множитель через

. Обозначим второй множитель через  , тогда неравенство перепишется в виде

, тогда неравенство перепишется в виде  или

или  Найдем

Найдем  в явном виде:

в явном виде:

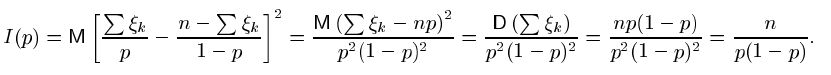

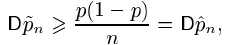

Подставляя найденное значение  в неравенство для дисперсии, получаем:

в неравенство для дисперсии, получаем:  т.е. оценка

т.е. оценка  действительно обладает наименьшей дисперсией из всех несмещенных состоятельных оценок

действительно обладает наименьшей дисперсией из всех несмещенных состоятельных оценок  . Теорема доказана.

. Теорема доказана.

Если задана произвольная оценка  параметра р, то представим ее математическое ожидание

параметра р, то представим ее математическое ожидание  в виде

в виде Тогда

Тогда  называется смещением оценки

называется смещением оценки  . Несмещенные оценки обладают нулевым смещением:

. Несмещенные оценки обладают нулевым смещением:

Для нашей оценки  очевидно,

очевидно,  т.е.. частота обладает наименьшим рассеянием, если рассеяние измеряется с помощью дисперсии.

т.е.. частота обладает наименьшим рассеянием, если рассеяние измеряется с помощью дисперсии.

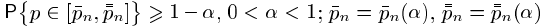

Интервальная оценка

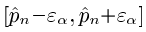

Интервальной оценкой параметра р называется интервал  , который обладает следующим свойством:

, который обладает следующим свойством:  При этом длина интервала должна быть наименьшей.

При этом длина интервала должна быть наименьшей.

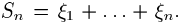

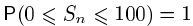

Контрольная работа пример с решением №1

Рассмотрим n = 100 бросаний правильной монеты (схема Бернулли с параметром р = 0,5),  — исход k-гo испытания (значение бернуллиевской случайной величины

— исход k-гo испытания (значение бернуллиевской случайной величины  )

)  Очевидно,

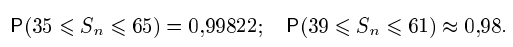

Очевидно, Прямой подсчет вероятностей показывает, что

Прямой подсчет вероятностей показывает, что

Таким образом  — доверительный интервал для параметра р с доверительной вероятностью 0,99822, а

— доверительный интервал для параметра р с доверительной вероятностью 0,99822, а — доверительный интервал для параметра р с доверительной вероятностью

— доверительный интервал для параметра р с доверительной вероятностью

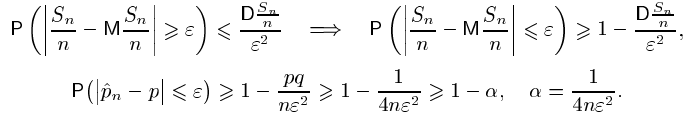

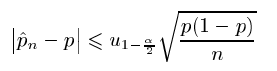

Для построения доверительного интервала для схемы Бернулли запишем для оценки  неравенство Чебышёва:

неравенство Чебышёва:

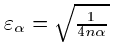

Теперь зададим произвольное  . Тогда для

. Тогда для  получим:

получим:

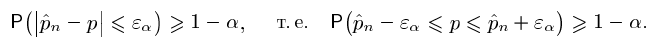

Таким образом, мы построили интервал , в котором с задаваемой нами вероятностью ошибки (х находится неизвестный параметр р. Он называется доверительным интервалом для параметра р с доверительной вероятностью

, в котором с задаваемой нами вероятностью ошибки (х находится неизвестный параметр р. Он называется доверительным интервалом для параметра р с доверительной вероятностью  (или с вероятностью ошибки

(или с вероятностью ошибки  ). Чем меньше мы выбираем

). Чем меньше мы выбираем  , тем больше этот интервал. Для заданного

, тем больше этот интервал. Для заданного  длину интервала можно уменьшить за счёт увеличения числа испытаний n.

длину интервала можно уменьшить за счёт увеличения числа испытаний n.

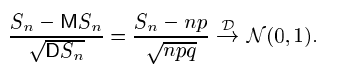

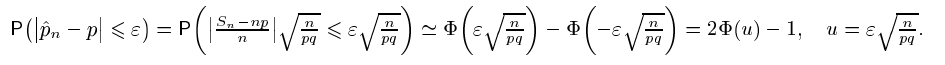

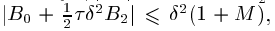

Укажем еще один (более точный) способ нахождения интервальной оценки в схеме Бернулли. По теореме Муавра-Лапласа число «успехов» схемы Бернулли с ростом п стремится к нормальной случайной величине:

Используя это, можно оценить вероятность

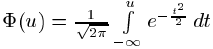

Здесь  — функция распределения стандартной нормальной случайной величины.

— функция распределения стандартной нормальной случайной величины.

Фиксируем  Нам нужно, чтобы

Нам нужно, чтобы  т.е.

т.е.  Обозначим такое значение

Обозначим такое значение  , при котором это выполнено, через

, при котором это выполнено, через  (квантиль порядка 1 — нормального распределения, находится из таблицы квантилей). Тогда искомое

(квантиль порядка 1 — нормального распределения, находится из таблицы квантилей). Тогда искомое  найдем из условия

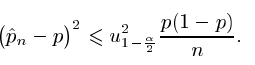

найдем из условия  Итак, неравенство

Итак, неравенство

выполняется с вероятностью  Осталось найти границы доверительного интервала. Возведем неравенство в квадрат:

Осталось найти границы доверительного интервала. Возведем неравенство в квадрат:

Получили квадратное уравнение на р. В качестве  и

и  берут корни этого квадратного уравнения (можно показать, что всегда D > 0 и корней действительно два).

берут корни этого квадратного уравнения (можно показать, что всегда D > 0 и корней действительно два).

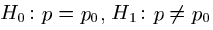

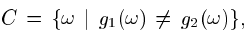

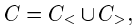

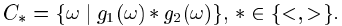

Выбор из двух гипотез

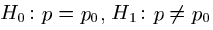

Пусть задано  . Рассмотрим две (взаимоисключающих) гипотезы о параметре р:

. Рассмотрим две (взаимоисключающих) гипотезы о параметре р:  (основная, или нулевая, гипотеза) и

(основная, или нулевая, гипотеза) и  (альтернативная, или конкурирующая, гипотеза). (Например,

(альтернативная, или конкурирующая, гипотеза). (Например,  ) Наша задача: выбрать из этих двух гипотез ту, которой соответствует наименьшая вероятность ошибки.

) Наша задача: выбрать из этих двух гипотез ту, которой соответствует наименьшая вероятность ошибки.

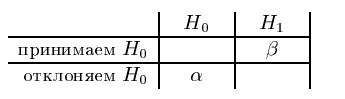

Определение. Вероятность ошибки I рода — это вероятность отклонить верную гипотезу  . Вероятность ошибки II рода — это вероятность принять неверную гипотезу

. Вероятность ошибки II рода — это вероятность принять неверную гипотезу  .

.

Критерий проверки гипотезы  — это правило, на основании которого мы можем считать, что она верна или неверна (т.е. принимаем ее или не принимаем). Составим таблицу:

— это правило, на основании которого мы можем считать, что она верна или неверна (т.е. принимаем ее или не принимаем). Составим таблицу:

Здесь вероятность ошибки I рода (отклоняем  в то время как она верна) обозначена через а, а вероятность ошибки II рода (принимаем неверную гипотезу

в то время как она верна) обозначена через а, а вероятность ошибки II рода (принимаем неверную гипотезу  ) —

) —

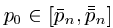

Рассмотрим две гипотезы  (

( задано). Пусть для параметра р получена интервальная оценка для заданной вероятности ошибки

задано). Пусть для параметра р получена интервальная оценка для заданной вероятности ошибки  — доверительный интервал

— доверительный интервал  . Тогда можно предложить такой критерий:

. Тогда можно предложить такой критерий:

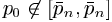

1) Если  , то

, то  принимаем (и соответственно, отклоняем

принимаем (и соответственно, отклоняем  );

);

2) Если  , то

, то  отклоняем (и тем самым принимаем

отклоняем (и тем самым принимаем  ).

).

Поскольку  — доверительный интервал с доверительной вероятностью

— доверительный интервал с доверительной вероятностью  , то вероятность ошибки I рода не превосходит

, то вероятность ошибки I рода не превосходит  .

.

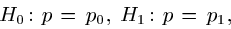

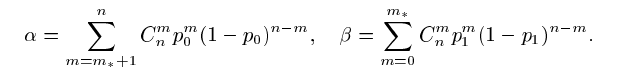

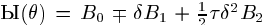

Рассмотрим еще один пример гипотез о параметре р схемы Бернулли. Пусть  где

где  заданы, и пусть

заданы, и пусть  — вероятность ошибки I рода,

— вероятность ошибки I рода,  — вероятность ошибки II рода. Как всегда, обозначаем

— вероятность ошибки II рода. Как всегда, обозначаем  Тогда существует такой критерий: если

Тогда существует такой критерий: если  , то

, то  отклоняем (тем самым принимая

отклоняем (тем самым принимая  ), а, если

), а, если , то

, то  принимаем (

принимаем ( отклоняем). Число

отклоняем). Число  называется критическим значением и находится из соображений минимизации при фиксированном n сумм (вероятностей ошибок I и II рода)

называется критическим значением и находится из соображений минимизации при фиксированном n сумм (вероятностей ошибок I и II рода)

Задача 1.1. Пусть заданы  Найти наименьшее значение п и соответствующее ему

Найти наименьшее значение п и соответствующее ему  (n) такие, что данный критерий различает гипотезы

(n) такие, что данный критерий различает гипотезы  и

и  с вероятностями ошибок I и II рода, не превосходящими соответственно

с вероятностями ошибок I и II рода, не превосходящими соответственно  и

и  .

.

На этом я завершаю обзор. Далее речь пойдёт подробнее о точечных оценках, интервальных оценках и проверке гипотез.

Общие понятия математической статистики

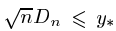

Статистическая модель. Точечные оценки

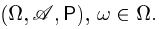

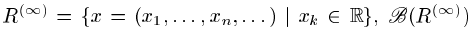

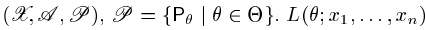

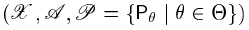

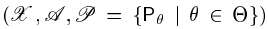

Фундаментальным понятием теории вероятностей является вероятностная модель (вероятностное пространство) — это тройка  , где

, где  — пространство элементарных событий,

— пространство элементарных событий,  —

—  -алгебра подмножеств этого пространства (событий), Р — вероятностная мера на

-алгебра подмножеств этого пространства (событий), Р — вероятностная мера на  алгебре

алгебре  .

.

Основным объектом исследования математической статистики является статистическая модель. Определим это понятие.

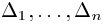

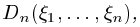

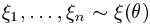

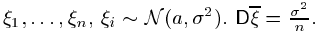

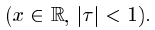

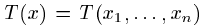

Результатом статистического эксперимента являются вещественные числа  — статистические данные. Это значения случайных величин

— статистические данные. Это значения случайных величин  Иx совокупность

Иx совокупность  называется выборкой размера (порядка) n.

называется выборкой размера (порядка) n.

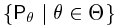

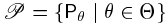

Определение. Статистической моделью называется тройка  где

где  — выборочное пространство, т.е. совокупность всевозможных выборок размера n ,

— выборочное пространство, т.е. совокупность всевозможных выборок размера n ,  —

—  -алгебра на выборочном пространстве,

-алгебра на выборочном пространстве,  — некоторое семейство распределений вероятностей, заданное на

— некоторое семейство распределений вероятностей, заданное на  .

.

В простейшем случае считаем, что  а

а  — борелевская

— борелевская  -алгебра.

-алгебра.

Примерами семейств распределений могут служить, например, семейство бернуллиевских распределений,  ; семейство пуассоновских распределений,

; семейство пуассоновских распределений,  ; семейство биномиальных распределений с параметрами (n ,р), где те фиксировано, а

; семейство биномиальных распределений с параметрами (n ,р), где те фиксировано, а  и т.д.

и т.д.

Наша цель — выделить из семейства распределений то единственное распределение, которое наилучшим образом соответствует нашим запросам, точнее, полученной выборке (после этого мы сможем работать с вероятностной моделью).

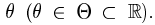

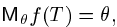

Если  , где

, где  — параметр,

— параметр,  — параметрическое множество, то говорят, что

— параметрическое множество, то говорят, что  — параметрическое семейство распределений, а

— параметрическое семейство распределений, а  — параметрическая модель.

— параметрическая модель.

Пусть имеется случайный вектор  со значениями (

со значениями ( ) в выборочном пространстве

) в выборочном пространстве  В соответствии с определением статистической модели,

В соответствии с определением статистической модели,  — семейство распределений случайного вектора

— семейство распределений случайного вектора  . Чтобы не путать набор случайных величин (случайный вектор)

. Чтобы не путать набор случайных величин (случайный вектор)  с его конкретными значениями

с его конкретными значениями  говорят, что

говорят, что  — выборка, a

— выборка, a  — случайная выборка.

— случайная выборка.

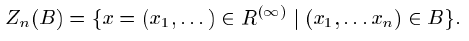

Обоснование предельного перехода при стремлении размера выборки к бесконечности

Считаем, что  — n-мерное евклидово пространство . Рассмотрим последовательность выборочных пространств

— n-мерное евклидово пространство . Рассмотрим последовательность выборочных пространств

с вероятностными мерами  Исследуем их предельные свойства при т

Исследуем их предельные свойства при т

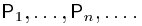

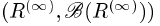

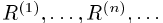

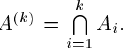

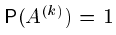

Определение. Вероятностные меры  называются согласованными, если

называются согласованными, если

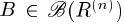

Введём пространство где

где  — борелевская

— борелевская  -алгебра.

-алгебра.

Определение. Пусть . Тогда борелевским цилиндром называется следующее множество:

. Тогда борелевским цилиндром называется следующее множество:

Теорема 2.1 (Колмогоров). Если меры на  согласованы, то существует единственная вероятностная мера Р на

согласованы, то существует единственная вероятностная мера Р на  такая, что

такая, что  для всех

для всех  и для всех натуральных n.

и для всех натуральных n.

Эта теорема обосновывает законность перехода к пределу при  ( n — размер выборки).

( n — размер выборки).

Модель повторных испытаний

Определение. Моделью повторных испытаний называется статистическая модель, в которой случайные величины  (со значениями

(со значениями  соответственно, (

соответственно, ( )

)  ) независимы и одинаково распределены.

) независимы и одинаково распределены.

В дальнейшем мы будем рассматривать только модели повторных испытаний.

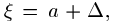

Пример 1.1. Рассмотренная выше статистическая модель схемы Бернулли — модель повторных испытаний. Действительно, в этом случае рассматриваются независимые испытания с одним и тем же распределением вероятности  где

где  — параметр.

— параметр.

Контрольная работа пример с решением №2

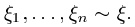

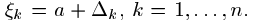

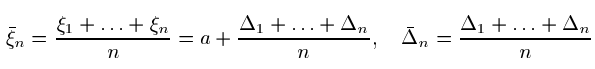

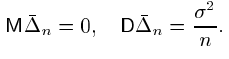

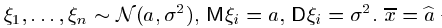

Рассмотрим эксперимент по измерению температуры. Мы считаем, что измерения независимы и результаты измерений — значения одинаково распределенных случайных величин  На практике обычно результаты измерений колеблются около некоторого постоянного значения а, поэтому удобно рассматривать

На практике обычно результаты измерений колеблются около некоторого постоянного значения а, поэтому удобно рассматривать  в виде

в виде  где

где  — случайная ошибка, или в координатах:

— случайная ошибка, или в координатах:  Случайные величины

Случайные величины  также независимы и одинаково распределены; при этом

также независимы и одинаково распределены; при этом  Средняя температура вычисляется как среднее арифметическое результатов измерений:

Средняя температура вычисляется как среднее арифметическое результатов измерений:

—средняя ошибка,

—средняя ошибка,

Выборочные характеристики

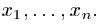

Пусть в некоторой статистической модели имеется выборка порядка n:

Определение. Статистикой называется произвольная измеримая функция  от элементов выборки

от элементов выборки

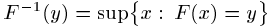

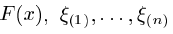

Определение. Если случайная величина  имеет распределение F(x), то медианой распределения называется такое число р, что

имеет распределение F(x), то медианой распределения называется такое число р, что

Медиана распределения обладает тем свойством, что

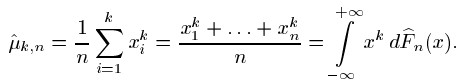

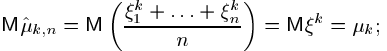

Рассмотрим примеры наиболее часто встречающихся статистик (или выборочных характеристик):

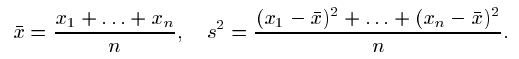

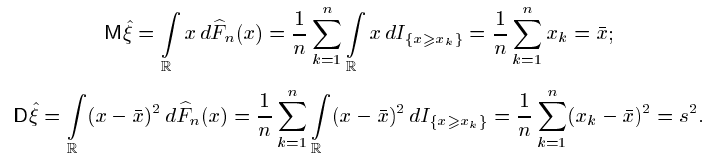

Выборочное среднее:

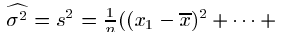

Выборочная дисперсия:

Выборочный момент порядка к:

Выборочный центральный момент порядка к:

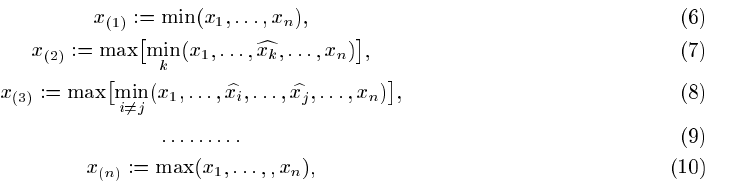

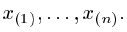

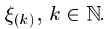

Порядковые статистики: упорядочим элементы выборки по возрастанию, получим последовательность

Она называется вариационным рядом выборки, а её элементы — порядковыми статистиками. Случайные величины со значениями  также называются порядковыми статистиками. Более формально,

также называются порядковыми статистиками. Более формально,

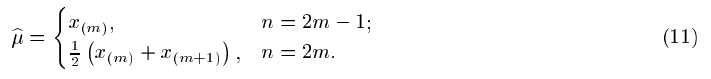

где «крышка», как обычно, означает пропуск этого элемента. Выборочная медиана:

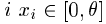

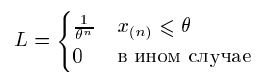

Пример 1.3. Рассмотрим равномерное распределение на  — неизвестный параметр. Параметр

— неизвестный параметр. Параметр  можно оценить двумя способами:

можно оценить двумя способами:

1. — несмещённая оценка

— несмещённая оценка

2. (оценка по крайней точке) — смещённая, но средне-квадратичная ошибка меньше, чем у

(оценка по крайней точке) — смещённая, но средне-квадратичная ошибка меньше, чем у  .

.

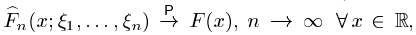

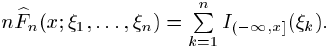

Эмпирическая функция распределения.

Определение и свойства

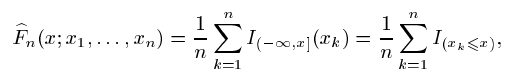

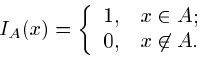

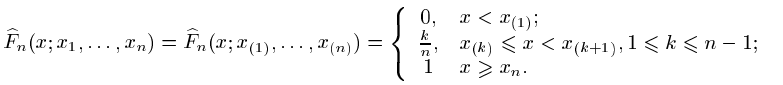

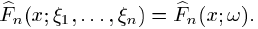

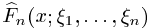

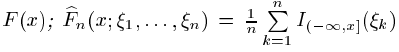

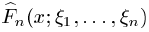

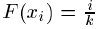

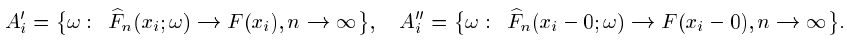

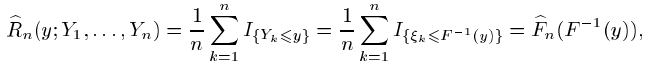

Определение. Эмпирической функцией распределения для данной выборки  называется функция

называется функция

где — индикатор множества А.

— индикатор множества А.

Перейдем от выборки  к вариационному ряду (совокупности порядковых статистик); иными словами, упорядочим выборку по возрастанию:

к вариационному ряду (совокупности порядковых статистик); иными словами, упорядочим выборку по возрастанию:  . Тогда, очевидно, эмпирическая функция распределения может быть записана в виде

. Тогда, очевидно, эмпирическая функция распределения может быть записана в виде

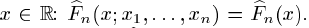

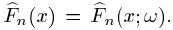

Если выборка  фиксирована, то эмпирическая функция распределения — это функция от переменной

фиксирована, то эмпирическая функция распределения — это функция от переменной Она является функцией распределения некоторой случайной величины

Она является функцией распределения некоторой случайной величины  (проверьте это!):

(проверьте это!):

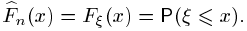

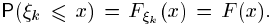

Если же выборка не фиксирована, а случайные величины  породившие эту выборку, независимы и одинаково распределены с функцией распределения F(x), то можно рассматривать

породившие эту выборку, независимы и одинаково распределены с функцией распределения F(x), то можно рассматривать  Для каждого

Для каждого  это случайная величина:

это случайная величина:

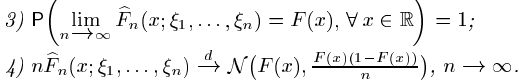

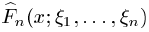

Теорема 2.2. 1) Случайная величина  имеет биномиальное распределение с параметрами (п,р = F(x)) при любом фиксированном

имеет биномиальное распределение с параметрами (п,р = F(x)) при любом фиксированном  ;

;

2)  является несмещенной состоятельной оценкой F(x);

является несмещенной состоятельной оценкой F(x);

Найдем распределение случайной величины  при любом фиксированном

при любом фиксированном  . Если

. Если  то

то  , а если

, а если  то

то  Значит, при каждом

Значит, при каждом  это частота наступления события

это частота наступления события  , вероятность которого равна

, вероятность которого равна  Отсюда получаем, что случайная величина

Отсюда получаем, что случайная величина  имеет биномиальное распределение с параметрами (n,р — F(x)) при любом фиксированном

имеет биномиальное распределение с параметрами (n,р — F(x)) при любом фиксированном  (утверждение 1) теоремы). Её математическое ожидание и дисперсия соответственно равны nр и nр( 1 — р), поэтому получаем

(утверждение 1) теоремы). Её математическое ожидание и дисперсия соответственно равны nр и nр( 1 — р), поэтому получаем

Таким образом, эмпирическую функцию распределения  можно рассматривать как оценку (теоретической) функции распределения F(x). Поскольку

можно рассматривать как оценку (теоретической) функции распределения F(x). Поскольку  то эта оценка несмещенная, а в силу неравенства Чебышева

то эта оценка несмещенная, а в силу неравенства Чебышева  т.е.

т.е.  значит эта оценка состоятельная. Таким образом, утверждение 2) также доказано.

значит эта оценка состоятельная. Таким образом, утверждение 2) также доказано.

Утверждение 3) следует из УЗБЧ для схемы Бернулли (теорема Бореля), а утверждение 4) — из формул (12) и центральной предельной теоремы для независимых одинаково распределенных случайных величин, примененной к сумме

Задача 2.1. Доказать, что  является эффективной оценкой F(x)

является эффективной оценкой F(x)

На самом деле имеет место еще более сильное утверждение, чем утверждение 3) доказанной теоремы, а именно равномерная сходимость к F(x) с вероятностью 1, что и составляет содержание следующей теоремы.

к F(x) с вероятностью 1, что и составляет содержание следующей теоремы.

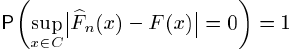

Теорема Гливенко — Кантелли

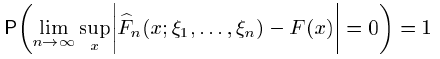

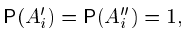

Теорема 2.3 (Гливенко — Кантелли). Пусть  — взаимно независимые, одинаково распределенные случайные величины с функцией распределения

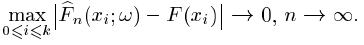

— взаимно независимые, одинаково распределенные случайные величины с функцией распределения — их эмпирическая функция распределения. Тогда

— их эмпирическая функция распределения. Тогда

(m. e.  равномерно сходится к F(x) с вероятностью 1).

равномерно сходится к F(x) с вероятностью 1).

Замечание. Для определения эмпирической функции распределения в теореме Гливенко — Кантелли не требуется понятия выборки: она определяется для заданного (известного) набора взаимно независимых одинаково распределенных случайных величин.

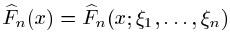

Для краткости будем обозначать эмпирическую функцию распределения через  По условию теоремы, F(x) — функция распределения случайных величин

По условию теоремы, F(x) — функция распределения случайных величин  Рассмотрим два случая.

Рассмотрим два случая.

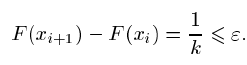

1) Пусть F(x) — непрерывная и строго монотонная функция. Фиксируем произвольное  и

и

Поскольку функция F(x) непрерывна и строго монотонна, то для каждого i = 0, ….k найдется

Поскольку функция F(x) непрерывна и строго монотонна, то для каждого i = 0, ….k найдется  .

.  (возможно,

(возможно,  или

или  ), причем такие

), причем такие  определены однозначно. Для соседних точек, по определению,

определены однозначно. Для соседних точек, по определению,

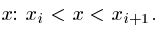

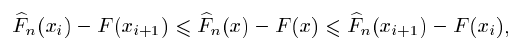

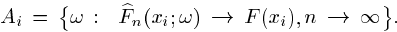

Зафиксируем i и произвольную точку  В силу монотонности функций F и

В силу монотонности функций F и  имеем:

имеем:

и используя неравенство (13), отсюда получаем:

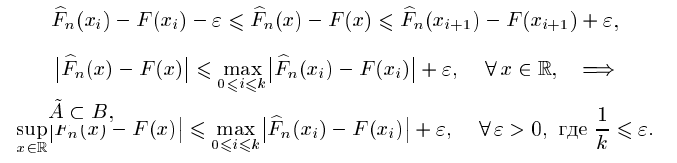

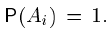

Рассмотрим событие  По УЗБЧ для схемы Бернулли

По УЗБЧ для схемы Бернулли

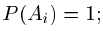

Далее, рассмотрим событие Его вероятность равна

Его вероятность равна  (проверьте!). Очевидно, событие АW равносильно тому, что

(проверьте!). Очевидно, событие АW равносильно тому, что  Определим события

Определим события

В силу неравенства (15)  а, поскольку

а, поскольку  то и Р(В) = 1.

то и Р(В) = 1.

2) Пусть теперь F(x) — произвольная (неубывающая) непрерывная функция. Тогда определим  так:

так:

Далее рассуждаем аналогично первому случаю. Осталось заметить, что при применении УЗБЧ для схемы Бернулли в данном случае нужно представить событие  в виде

в виде  , где

, где

Вероятность каждого из этих событий равна  поэтому и

поэтому и  дальнейшие рассуждения в точности такие же, как и в случае 1).

дальнейшие рассуждения в точности такие же, как и в случае 1).

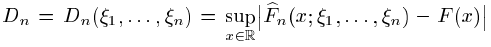

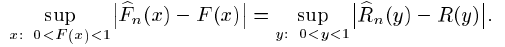

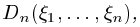

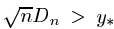

Статистика Колмогорова

Пусть дана случайная выборка  — независимые одинаково распределенные случайные величины с непрерывной функцией распределения F(x).

— независимые одинаково распределенные случайные величины с непрерывной функцией распределения F(x).

Определение. Случайная величина  — называется статистикой Колмогорова.

— называется статистикой Колмогорова.

В терминах статистики Колмогорова теорему Гливенко — Кантелли можно переформулировать так:  сходится к нулю при

сходится к нулю при  с вероятностью 1 (т. е. Р-п.н.).

с вероятностью 1 (т. е. Р-п.н.).

Вид асимптотической функции распределения статистики  дает следующая теорема.

дает следующая теорема.

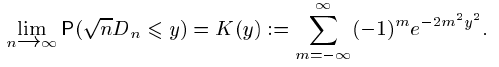

Теорема 2.4 (Колмогоров). Если функция F(x) непрерывна, то при любом у > 0

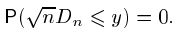

Замечание. Для  очевидно,

очевидно,

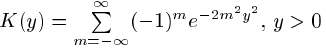

Участвующая в теореме функция  называется функцией Колмогорова.

называется функцией Колмогорова.

Мы докажем только часть теоремы Колмогорова, а именно следующую лемму:

Лемма 2.5. Распределение статистики Колмогорова  где

где  — независимые одинаково распределенные случайные величины с непрерывной функцией распределения F(x), не зависит от вида функции F(x).

— независимые одинаково распределенные случайные величины с непрерывной функцией распределения F(x), не зависит от вида функции F(x).

Рассмотрим два случая.

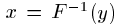

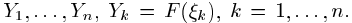

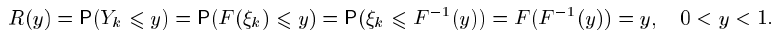

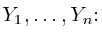

1) Пусть у = F(x) — непрерывная и строго монотонная функция. Тогда существует обратная функция: . Рассмотрим случайные величины

. Рассмотрим случайные величины  Они независимы и имеют одинаковое равномерное распределение на отрезке [0,1]:

Они независимы и имеют одинаковое равномерное распределение на отрезке [0,1]:

Эмпирическая функция распределения

где  — эмпирическая функция распределения случайной выборки

— эмпирическая функция распределения случайной выборки

Рассмотрим очевидное равенство

Его левая часть с вероятностью 1 совпадает с  а правая часть — с

а правая часть — с  Статистика

Статистика  от вида функции F(x) не зависит, поскольку от F(x) не зависит распределение случайных величин 1*1,…, Yn.

от вида функции F(x) не зависит, поскольку от F(x) не зависит распределение случайных величин 1*1,…, Yn.

Для завершения доказательства осталось показать, что на множестве  или F(x) = 1} эмпирическая функция распределения

или F(x) = 1} эмпирическая функция распределения  и теоретическая F(x) совпадают с вероятностью 1. Для этого достаточно проверить, что

и теоретическая F(x) совпадают с вероятностью 1. Для этого достаточно проверить, что  Проверку этого факта мы предоставляем читателю.

Проверку этого факта мы предоставляем читателю.

2) Если функция F(x) — произвольная (неубывающая) непрерывная функция, то рассуждения аналогичны предыдущему случаю, только в этом случае нужно положить

Читателю рекомендуется аккуратно провести рассуждения для этого случая самостоятельно.

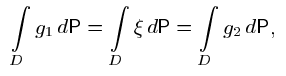

Критерий Колмогорова

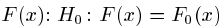

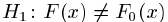

Рассмотрим две гипотезы о функции распределения  (нулевая гипотеза), где

(нулевая гипотеза), где  — заданная непрерывная функция распределения;

— заданная непрерывная функция распределения;  (альтернативная гипотеза).

(альтернативная гипотеза).

Статистика Колмогорова позволяет сформулировать критерий, согласно которому выбирается одна из этих двух гипотез. А именно:

Критерий Колмогорова. Если  , то

, то  отклоняем (

отклоняем ( принимаем), если же

принимаем), если же  то

то  принимаем (

принимаем ( отклоняем). Здесь число

отклоняем). Здесь число  называется критическим значением и равно

называется критическим значением и равно  — квантиль уровня (1 — а) функции Колмогорова К (у) (т. е. решение уравнения К (у) = 1 — а). На практике для заданного

— квантиль уровня (1 — а) функции Колмогорова К (у) (т. е. решение уравнения К (у) = 1 — а). На практике для заданного  квантиль

квантиль находится по таблице квантилей функции Колмогорова. Действительно, по теореме Колмогорова

находится по таблице квантилей функции Колмогорова. Действительно, по теореме Колмогорова

т. е. вероятность ошибки I рода приближенно равна а (если п достаточно велико).

т. е. вероятность ошибки I рода приближенно равна а (если п достаточно велико).

Выборочные характеристики как характеристики эмпирической функции распределения

Напомним некоторые определенные в п. 2.1.4 выборочные характеристики — выборочное среднее и выборочную дисперсию:

Утверждение 2.6.  и

и  — соответственно математическое ожидание и дисперсия эмпирического распределения (т. е. распределения, определяемого функцией распределения

— соответственно математическое ожидание и дисперсия эмпирического распределения (т. е. распределения, определяемого функцией распределения

Обозначим эмпирическое распределение  ) — функция распределения Тогда доказательство следует из соотношений

) — функция распределения Тогда доказательство следует из соотношений

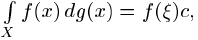

Здесь мы воспользовались определением эмпирической функции распределения, линейностью интеграла Стилтьеса и формулой для интеграла Стилтьеса  где g(х) — функция одного скачка (в точке

где g(х) — функция одного скачка (в точке  ),

),  — величина скачка.

— величина скачка.

Аналогично можно показать, что выборочные моменты порядка к являются моментами порядка к эмпирического распределения. Покажем, что выборочные моменты можно рассматривать как хорошие оценки моментов теоретического распределения.

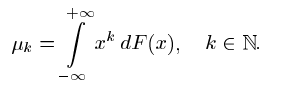

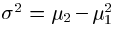

Пусть  — выборка, порожденная независимыми одинаково распределенными случайными величинами

— выборка, порожденная независимыми одинаково распределенными случайными величинами  — их (теоретическая) функция распределения (неизвестная, или известно в каком классе лежит, но неизвестно какая именно). Её k-тый момент равен

— их (теоретическая) функция распределения (неизвестная, или известно в каком классе лежит, но неизвестно какая именно). Её k-тый момент равен

( — математическое ожидание,

— математическое ожидание,  — второй момент,

— второй момент,  — дисперсия, и т.д.). Рассмотрим выборочные моменты — моменты эмпирического распределения:

— дисперсия, и т.д.). Рассмотрим выборочные моменты — моменты эмпирического распределения:

Если рассматривать как оценки

как оценки  , то легко получаем следующие её свойства:

, то легко получаем следующие её свойства:

1) Несмещённость:

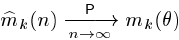

2) Состоятельность: по закону больших чисел

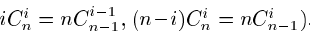

Распределение порядковых статистик

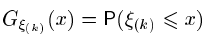

Пусть  — случайная выборка с теоретической функцией распределения

— случайная выборка с теоретической функцией распределения  — её порядковые статистики.

— её порядковые статистики.

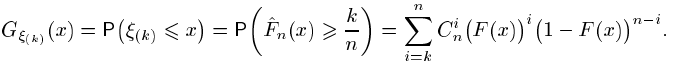

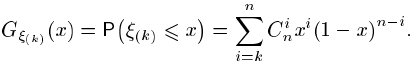

Найдем распределение  . Пусть

. Пусть  — функция распределения

— функция распределения  . При каждом фиксированном

. При каждом фиксированном  имеем:

имеем:

Контрольная работа пример с решением №3

Пусть F(x) — функция распределения равномерного распределения на отрезке [0,1]: F(x) = х, 0 < х < 1. Тогда

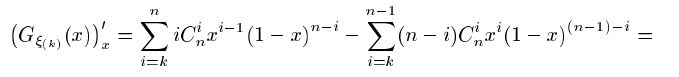

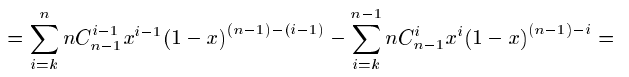

Найдем плотность этого распределения. Для этого продифференцируем функцию распределения:

(во втором равенстве воспользовались тождествами  .Таким образом, плотность

.Таким образом, плотность

распределения  равна

равна а функция распределения —

а функция распределения —

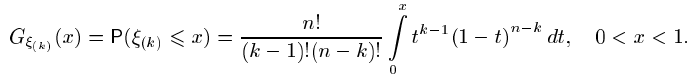

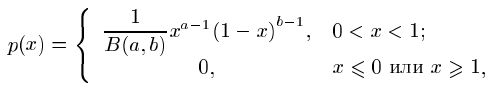

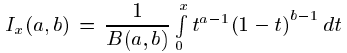

Определение. Пусть а > 0, b > 0. Распределение с плотностью

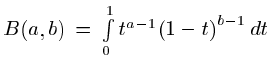

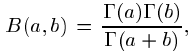

где  — бета-функция (эйлеров интеграл I рода), называется бета-распределением с параметрами а > 0, b > 0. Функция распределения бета-распределения

— бета-функция (эйлеров интеграл I рода), называется бета-распределением с параметрами а > 0, b > 0. Функция распределения бета-распределения  называется неполной бета-функцией.

называется неполной бета-функцией.

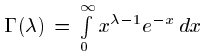

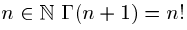

Из математического анализа известно, что где

где  — гамма-функция Эйлера (эйлеров интеграл II рода), и для

— гамма-функция Эйлера (эйлеров интеграл II рода), и для  , поэтому формулу (16) можно переписать в виде

, поэтому формулу (16) можно переписать в виде

Таким образом, нами доказан следующий результат.

Утверждение 2.7. Распределение порядковой статистики ,  для случайной выборки

для случайной выборки с равномерным распределением на отрезке [0,1] является бета-распределением с параметрами а = к, b = п — к + 1.

с равномерным распределением на отрезке [0,1] является бета-распределением с параметрами а = к, b = п — к + 1.

Замечание. Функция распределения порядковых статистик в случае произвольной непрерывной функции распределения F(x) случайной выборки  имеет вид

имеет вид

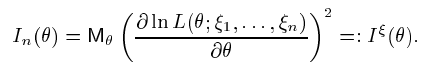

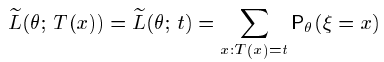

Функция правдоподобия. Регулярные модели

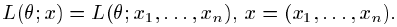

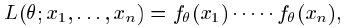

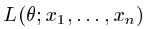

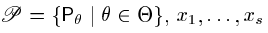

Пусть в некоторой статистической модели  имеется выборка

имеется выборка  порожденная случайной выборкой

порожденная случайной выборкой  , где случайные величины

, где случайные величины  независимы и одинаково распределены с функцией распределения

независимы и одинаково распределены с функцией распределения  — параметр распределения.

— параметр распределения.

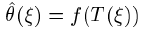

Оценка параметра  — это подходящая статистика (измеримая функция от выборочных данных):

— это подходящая статистика (измеримая функция от выборочных данных):  Пусть имеются две оценки параметра

Пусть имеются две оценки параметра  . Определим, что значит, что одна оценка «лучше» другой.

. Определим, что значит, что одна оценка «лучше» другой.

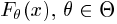

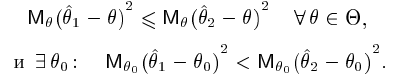

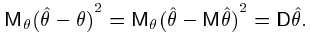

Определение. Пусть  и

и  — две оценки параметра

— две оценки параметра  . Говорят, что оценка

. Говорят, что оценка  лучше (или предпочтительней) оценки

лучше (или предпочтительней) оценки  , если

, если

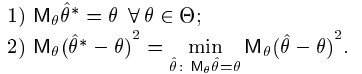

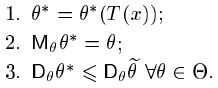

Определение. Эффективной оценкой параметра в называется несмещенная оценка с минимальной дисперсией, т.е. такая оценка  , для которой выполнены следующие свойства:

, для которой выполнены следующие свойства:

Напомним, что для несмещенных оценок среднеквадратичное отклонение совпадает с дисперсией:

Таким образом, эффективная оценка — это наилучшая из всех несмещенных оценок. Аналогично можно определить эффективную оценку в классе оценок с заданным смещением

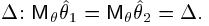

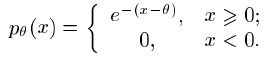

Нас будут интересовать два случая: распределение  дискретно (с распределением вероятностей или абсолютно непрерывно (с плотностью

дискретно (с распределением вероятностей или абсолютно непрерывно (с плотностью  ). Чтобы в дальнейшем не рассматривать эти случаи отдельно, введем следующее удобное обозначение:

). Чтобы в дальнейшем не рассматривать эти случаи отдельно, введем следующее удобное обозначение:

В дальнейшем придется интегрировать по выборочному пространству, поэтому отметим, что если модель дискретна, то интегрирование заменяется суммированием (для краткости, мы будем проводить все выкладки для абсолютно непрерывной модели).

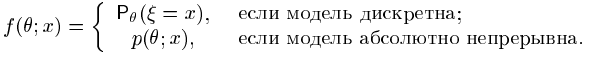

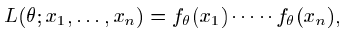

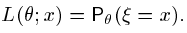

Определение. Функцией правдоподобия (для данной выборки  ) называется следующая функция (параметра

) называется следующая функция (параметра  ):

):

В дальнейшем для краткости мы будем писать

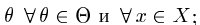

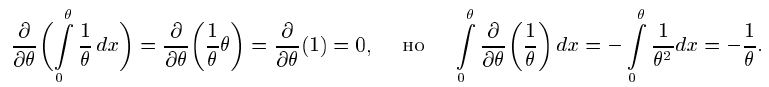

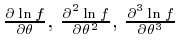

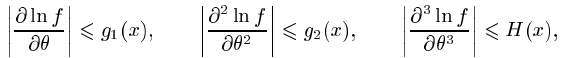

Определение. Статистическая модель называется регулярной (по Рао-Крамеру), если выполнены следующие условия (регулярности):

1)  и дифференцируема по

и дифференцируема по

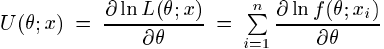

2) Случайная величина  (которая называется функцией вклада выборки) имеет ограниченную дисперсию:

(которая называется функцией вклада выборки) имеет ограниченную дисперсию:

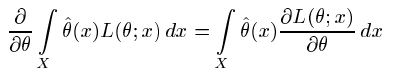

3) Для любой статистики  имеет место равенство

имеет место равенство

(Это означает, что выборочное пространство X не зависит от параметра  ).

).

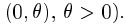

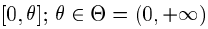

Пример 3.1. (нерегулярной модели). Рассмотрим модель  (равномерное распределение на отрезке

(равномерное распределение на отрезке  Условие 3) регулярности для этой модели не выполнено:

Условие 3) регулярности для этой модели не выполнено:

Таким образом, эта модель не является регулярной.

Задача 2.2. Проверить условие регулярности 3) для экспоненциального распределения с плотностью

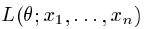

Количество информации Фишера. Неравенство Рао-Крамера

Информация Фишера

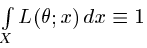

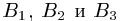

Пусть модель регулярна. Рассмотрим тождество  (оно выполнено, так как

(оно выполнено, так как  ) — плотность распределения случайного вектора

) — плотность распределения случайного вектора  ).Продифференцируем его по

).Продифференцируем его по  :

:

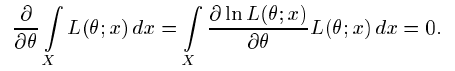

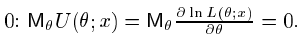

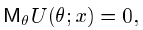

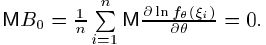

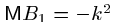

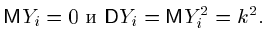

Отсюда следует, что математическое ожидание функции вклада равно

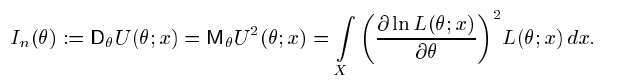

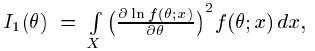

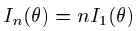

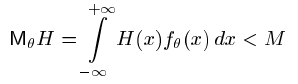

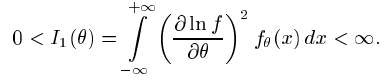

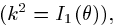

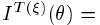

Определение. Количеством информации Фишера (или просто информацией Фишера) называется дисперсия функции вклада:

Количество информации для одного наблюдения равно а поскольку наблюдения (случайные величины)

а поскольку наблюдения (случайные величины)  независимы, то информация Фишера о выборке размера n равна

независимы, то информация Фишера о выборке размера n равна

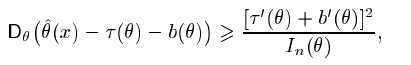

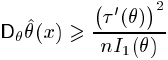

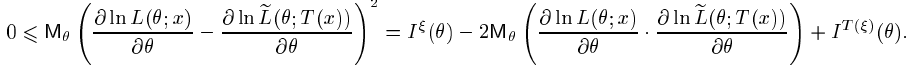

Неравенство Рао-Крамера

Пусть имеется регулярная модель с параметрическим семейством распределений  Следующая теорема дает нижнюю границу дисперсий оценок произвольной дифференцируемой функции от параметра

Следующая теорема дает нижнюю границу дисперсий оценок произвольной дифференцируемой функции от параметра  в классе оценок с заданным смещением.

в классе оценок с заданным смещением.

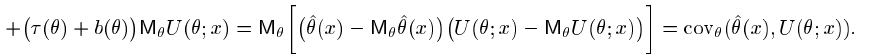

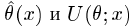

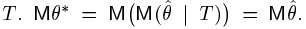

Теорема 2.8 (Неравенство Рао — Крамера). Пусть модель с параметрическим семейством распределений  регулярна,

регулярна,  — выборка, и пусть некоторая статистика

— выборка, и пусть некоторая статистика  Oценивает дифференцируемую функцию

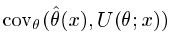

Oценивает дифференцируемую функцию  параметра

параметра  . Обозначим

. Обозначим  — смещение оценки

— смещение оценки  Если

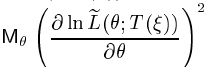

Если  — дифференцируемая функция, то справедливо неравенство

— дифференцируемая функция, то справедливо неравенство

где  — количество информации Фишера о выборке х. При этом неравенство обращается в равенство тогда и только тогда, когда оценка

— количество информации Фишера о выборке х. При этом неравенство обращается в равенство тогда и только тогда, когда оценка  является линейной функцией вклада выборки, т. е.

является линейной функцией вклада выборки, т. е.

В частности, если оценка  несмещенная,

несмещенная,  и с учетом

и с учетом неравенство принимает вид

неравенство принимает вид

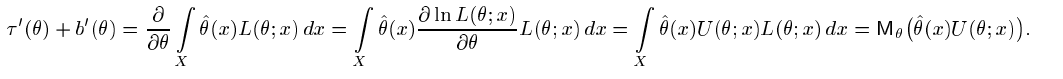

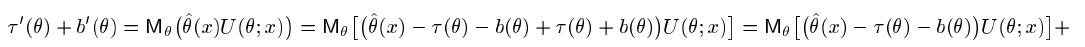

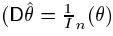

По определению смещения оценки  имеем

имеем  Продифференцируем это равенство, записав М$0(ж) в виде интеграла и пользуясь условием регулярности 3):

Продифференцируем это равенство, записав М$0(ж) в виде интеграла и пользуясь условием регулярности 3):

Учитывая, что  получаем:

получаем:

Применим к  неравенство Коши-Буняковского

неравенство Коши-Буняковского

Отсюда следует требуемое неравенство. А так как неравенство Коши — Буняковского превращается в равенство тогда и только тогда, когда функции (в нашем случае случайные величины) линейно связаны, то и наше неравенство превращается в равенство в том и только том случае, когда (при каждом  )

)  линейно связаны:

линейно связаны:  Теорема доказана.

Теорема доказана.

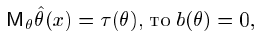

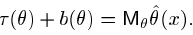

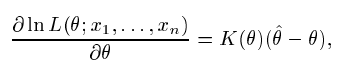

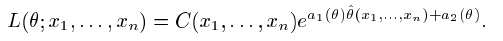

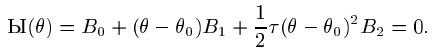

Семейства распределений экспоненциального типа

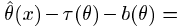

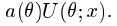

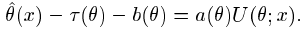

Если мы будем рассматривать несмещённые оценки параметра  то равенство в теореме Крамера-Рао

то равенство в теореме Крамера-Рао  достигается при

достигается при

где К не зависит от выборки (это условие пропорциональности, при котором неравенство Коши — Буняковского обращается в равенство). Отсюда

Мы получили явный вид функции правдоподобия. Это плотность параметрического семейства распределений, принадлежащих к так называемому экспоненциальному типу. Примерами таких распределений служат биномиальное, показательное, нормальное и другие.

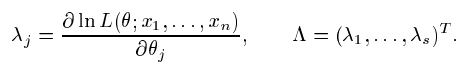

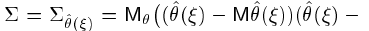

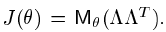

Многомерный случай

Пусть  — вектор-параметр,

— вектор-параметр,  Рассматривается оценка

Рассматривается оценка

Положим

Положим

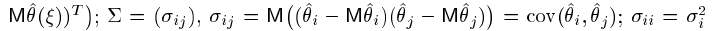

В многомерном случае роль дисперсии играет ковариационная матрица

— дисперсия, остальные — попарные ковариации. Несмещённость оценки задаётся равенством

— дисперсия, остальные — попарные ковариации. Несмещённость оценки задаётся равенством

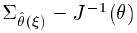

Аналогом количества информации Фишера является информационная матрица Фишера  Предположим, что эта матрица обратима (существует

Предположим, что эта матрица обратима (существует  ). Тогда имеет место аналог теоремы Крамера-Рао: матрица —

). Тогда имеет место аналог теоремы Крамера-Рао: матрица —  является неотрицательно определённой.

является неотрицательно определённой.

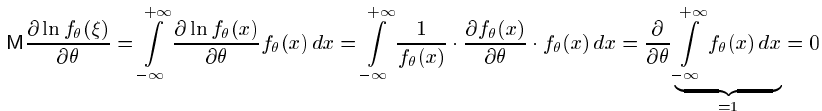

Методы получения оценок

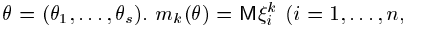

Метод моментов

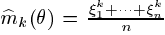

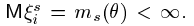

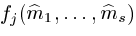

Рассматривается статистическая модель с s-мерным параметром  — выборка повторная) — к-й момент (истинный);

— выборка повторная) — к-й момент (истинный);  — эмпирический момент. Предположим, что

— эмпирический момент. Предположим, что  Эмпирические моменты являются оценками для истинных. Запишем систему моментных уравнений:

Эмпирические моменты являются оценками для истинных. Запишем систему моментных уравнений:

Рассмотрим полученную систему относительно переменных  . Пусть существует единственное решение

. Пусть существует единственное решение Мы получили некоторую оценку для

Мы получили некоторую оценку для  . Следующая теорема сообщает, что оценка не совсем плохая.

. Следующая теорема сообщает, что оценка не совсем плохая.

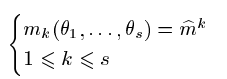

Теорема 2.9 (О состоятельности статистических оценок, полученных методом моментов). Пусть есть решение системы моментных уравнений и пусть функции

есть решение системы моментных уравнений и пусть функции непрерывны. Тогда оценки

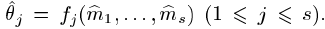

непрерывны. Тогда оценки =

=  для всех j являются состоятельными оценками параметров

для всех j являются состоятельными оценками параметров  (т.е.

(т.е.  для всех j).

для всех j).

Это следует из непрерывности  и асимптотического свойства моментов:

и асимптотического свойства моментов:

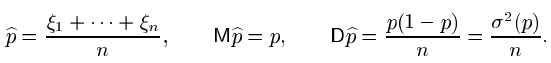

Пример 5.1. Схема Бернулли.  — параметр (вероятность удачи);

— параметр (вероятность удачи);  или 0.

или 0.

— первый выборочный момент,

— первый выборочный момент, — оценка р по методу моментов. Это хорошая оценка (несмещённая, состоятельная, эффективная в смысле неравенства Крамера-Рао).

— оценка р по методу моментов. Это хорошая оценка (несмещённая, состоятельная, эффективная в смысле неравенства Крамера-Рао).

Пример 5.2. — хорошая оценка,

— хорошая оценка,

— выборочная дисперсия — смещённая оценка

— выборочная дисперсия — смещённая оценка  . Это оценки, полученные по методу моментов. А вот такая оценка:

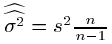

. Это оценки, полученные по методу моментов. А вот такая оценка:  является несмещённой.

является несмещённой.

Асимптотические свойства оценок

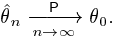

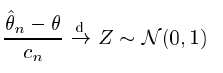

Состоятельность оценки.  — параметрическая модель,

— параметрическая модель,  — оценка по выборке длины те,

— оценка по выборке длины те,  — истинное значение параметра. Оценка состоятельна, если

— истинное значение параметра. Оценка состоятельна, если

Асимптотическая несмещённость.  (т.е. смещение

(т.е. смещение .

.

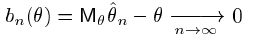

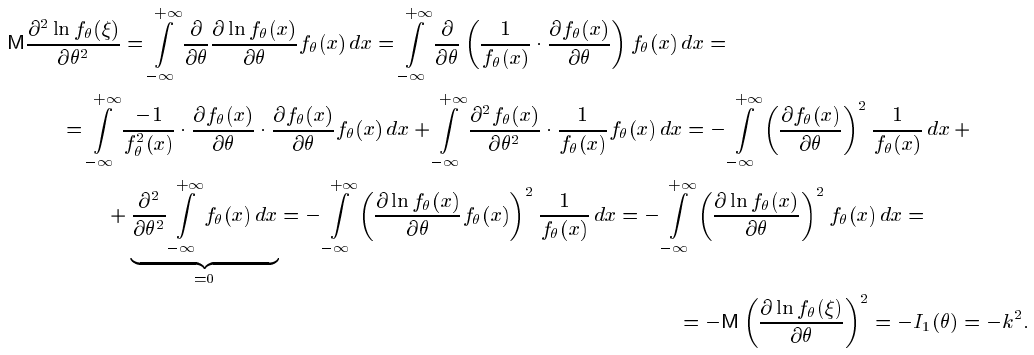

Асимптотическая нормальность.  асимптотически нормальна, если существует монотонно сходящаяся к нулю последовательность положительных чисел

асимптотически нормальна, если существует монотонно сходящаяся к нулю последовательность положительных чисел такая, что

такая, что

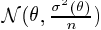

(сходимость по распределению к некоторой случайной величине со стандартным нормальным распределением). Говорят, что  асимптотически нормальна с

асимптотически нормальна с  , а

, а  асимптотически нормальна с

асимптотически нормальна с  ;

; в называется асимптотическим средним, а

в называется асимптотическим средним, а  — асимптотической дисперсией оценки

— асимптотической дисперсией оценки  . Асимптотически нормальная оценка автоматически является асимптотически несмещённой. В качестве

. Асимптотически нормальная оценка автоматически является асимптотически несмещённой. В качестве  обычно берут

обычно берут  (

( не зависит от выборки).

не зависит от выборки).

Пример 5.3. Схема Бернулли с параметром  (вероятность успеха).

(вероятность успеха).  — выборка.

— выборка.

асимптотически нормальна в силу теоремы Муавра — Лапласа (ЦПТ). (Обычно через эту теорему асимптотическую нормальность и доказывают.)

асимптотически нормальна в силу теоремы Муавра — Лапласа (ЦПТ). (Обычно через эту теорему асимптотическую нормальность и доказывают.)

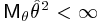

Контрольная работа пример с решением №4

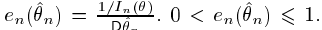

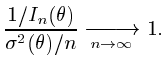

Асимптотическая эффективность. Рассмотрим семейство распределений, подчинённых условиям регулярности, для оценок параметров которого имеет место неравенство Крамера-Рао.  — нижняя граница дисперсий всех оценок. Коэффициент эффективности оценки:

— нижняя граница дисперсий всех оценок. Коэффициент эффективности оценки:

Если

то оценка называется эффективной.

Если

то оценка называется асимптотически эффективной.

Асимптотическая эффективность в рамках асимптотической нормальности. Пусть  асимптотически нормальна с

асимптотически нормальна с  . Она называется асимптотически эффективной (в рамках асимптотической нормальности), если

. Она называется асимптотически эффективной (в рамках асимптотической нормальности), если

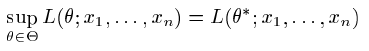

Метод максимального (наибольшего) правдоподобия

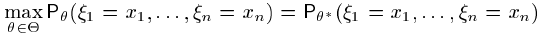

Принцип МП в простейшем случае Принцип МП был рассмотрен ещё Гауссом в следующей форме: найдём такие значения параметров, чтобы вероятность получить данную выборку была максимальной (берём

).  — оценка МП (наиболее правдоподобное значение

— оценка МП (наиболее правдоподобное значение  ).

).

Общая ситуация  — выборка в

— выборка в  — функция правдоподобия. Возьмём

— функция правдоподобия. Возьмём  такое, что

такое, что

(если точная верхняя грань достигается),  называется оценкой максимального правдоподобия (ОМП).

называется оценкой максимального правдоподобия (ОМП).

Контрольная работа пример с решением №5

взаимно независимы и равномерно распределены на

взаимно независимы и равномерно распределены на  .

.

где  — плотность равномерного распределения.

— плотность равномерного распределения.  тогда и только тогда, когда для всех

тогда и только тогда, когда для всех  .

.

Ясно, что максимум  достигается при

достигается при

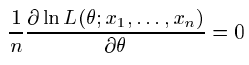

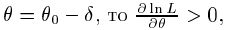

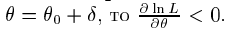

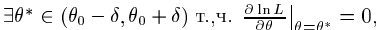

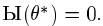

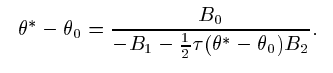

Предположим, что функция  дифференцируема по параметру в

дифференцируема по параметру в  . Тогда ОМП можно найти, решая уравнение правдоподобия:

. Тогда ОМП можно найти, решая уравнение правдоподобия:  (или переходим к логарифмам:

(или переходим к логарифмам:  , если это возможно). В случае

, если это возможно). В случае  получаем систему уравнений.

получаем систему уравнений.

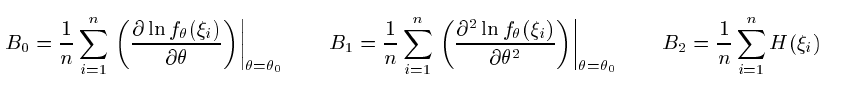

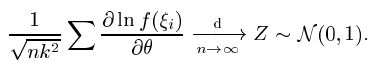

Теорема 2.10 (о свойствах ОМП — теорема Дюге). При выполнении условий регулярности (*) ОМП обладает, следующими асимптотическими свойствами:

- состоятельность;

- асимптотическая нормальность и асимптотическая эффективность. Условия регулярности (*):

— невырожденный замкнутый интервал на

— невырожденный замкнутый интервал на  ; существуют

; существуют  для

для  .

.

Для dcex  :

:

где  и

и  интегрируемы на

интегрируемы на  , a

, a  обладает следующим свойством:

обладает следующим свойством:

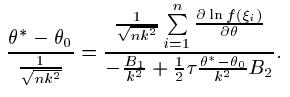

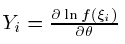

Эти условия содержат условия Крамера-Рао. Лемма 2.11. Пусть

(все  являются функциями от

являются функциями от  ). Тогда

). Тогда

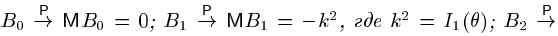

Предельные свойства  следуют из ЗБЧ (

следуют из ЗБЧ ( являются средними арифметическими независимых одинаково распределённых случайных величин с конечными математическими ожиданиями). В условиях регулярности меняем дифференцирование по в и интегрирование:

являются средними арифметическими независимых одинаково распределённых случайных величин с конечными математическими ожиданиями). В условиях регулярности меняем дифференцирование по в и интегрирование:

Откуда

Утверждение

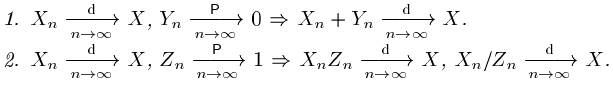

вытекает из следующей выкладки:

Лемма 2.12

(Это — задача по теории вероятностей) [Доказательство теоремы Дюге]

Вспоминаем, что

и переписываем уравнение правдоподобие

в виде

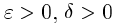

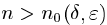

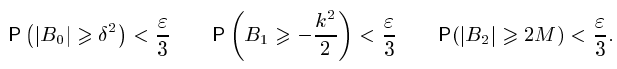

Зададим  — малые числа. Выберем

— малые числа. Выберем  так, чтобы

так, чтобы

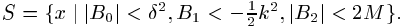

Положим

При

Пусть  . Положим

. Положим  . Так как

. Так как

при малых  знак выражения

знак выражения  определяется вторым слагаемым. Поэтому (при малых

определяется вторым слагаемым. Поэтому (при малых  ) если

) если

а если

Отсюда по непрерывности

т. е.  — точка максимума. Итак, с вероятностью, не меньшей, чем

— точка максимума. Итак, с вероятностью, не меньшей, чем  , точка максимума лежит в

, точка максимума лежит в  , откуда следует состоятельность.

, откуда следует состоятельность.

Докажем асимптотическую нормальность и асимптотическую эффективность. Имеем

Отсюда

Далее

независимые и одинаково распределённые с

В силу ЦПТ числитель

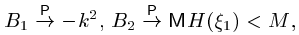

В силу леммы 2.11

откуда знаменатель

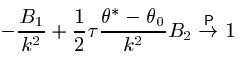

(второе слагаемое оценивается через  ). Тогда (в силу леммы 2.12)

). Тогда (в силу леммы 2.12)  асимптотически нормальна с

асимптотически нормальна с  . Отсюда

. Отсюда  асимптотически нормальна с

асимптотически нормальна с  , а т. к. асимптотическая дисперсия

, а т. к. асимптотическая дисперсия  , то

, то  асимптотически эффективна (в рамках асимптотической нормальности).

асимптотически эффективна (в рамках асимптотической нормальности).

Задача 2.3. Пусть  — регулярное параметрическое семейство распределений. Докажите, что если существует эффективная (в смысле неравенства Крамера-Рао) оценка

— регулярное параметрическое семейство распределений. Докажите, что если существует эффективная (в смысле неравенства Крамера-Рао) оценка  , то

, то  есть ОМП.

есть ОМП.

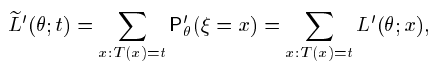

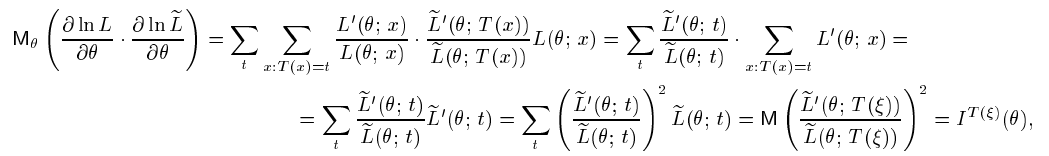

О свойствах информации Фишера

— выборка.

— выборка.  — функция правдоподобия. Информация Фишера:

— функция правдоподобия. Информация Фишера:

— информация в выборке

— информация в выборке  — это просто такое обозначение). Для информации Фишера выполняются все обычные свойства информации:

— это просто такое обозначение). Для информации Фишера выполняются все обычные свойства информации:

Утверждение 2.13 (свойства информации Фишера).

если

если  независимы.

независимы.- Для повторной выборки

.

. - Пусть

— измеримое пространство значений статистики

— измеримое пространство значений статистики  — распределение статистики

— распределение статистики  — функция правдоподобия для

— функция правдоподобия для  (статистика

(статистика  не обязательно одномерна),

не обязательно одномерна),

— информация Фишера в статистике

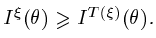

— информация Фишера в статистике  . Тогда

. Тогда

Докажем только пункт 3 (остальные тривиальны), да и то лишь п дискретном случае.

Далее (здесь штрих означает производную по  ),

),

откуда

поэтому

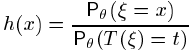

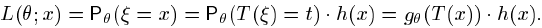

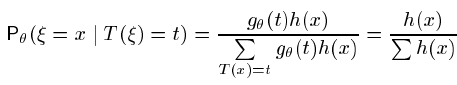

Достаточные статистики

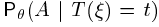

— параметрическая модель;

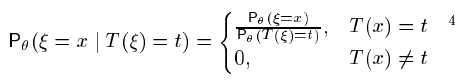

— параметрическая модель;  — выборка. Определение. Статистика

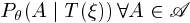

— выборка. Определение. Статистика  называется достаточной (для данной модели), если для всех

называется достаточной (для данной модели), если для всех  и для всех

и для всех  условная вероятность

условная вероятность  не зависит от

не зависит от  для всех

для всех  для которых определена условная вероятность.

для которых определена условная вероятность.

Найти достаточную статистику по определению не представляется возможным.

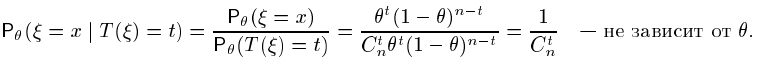

Контрольная работа пример с решением №6

Схема Бернулли.  . Пусть

. Пусть  и

и  таковы, что

таковы, что  . Тогда

. Тогда

Следовательно,  — достаточная статистика.

— достаточная статистика.

Теорема 2.14 (критерий достаточности — теорема Неймана —Фишера — теорема о факторизации).  — достаточная статистика тогда и только тогда, когда имеет, место следующее представление функции правдоподобия:

— достаточная статистика тогда и только тогда, когда имеет, место следующее представление функции правдоподобия:

где  и

и  — неотрицательные измеримые функции (каждая — в своей области).

— неотрицательные измеримые функции (каждая — в своей области).

Замечание.  — плотность совместного распределения

— плотность совместного распределения  по некоторой мере

по некоторой мере  ; семейство

; семейство  абсолютно непрерывно относительно меры

абсолютно непрерывно относительно меры  , плотность — производная Радона-IIикодима. Нам важны два случая: а)

, плотность — производная Радона-IIикодима. Нам важны два случая: а)  — мера Лебега, б)

— мера Лебега, б)  — считающая мера.

— считающая мера.

[Доказательство для дискретного случая]  — выборка.

— выборка.

Необходимость. Пусть  — достаточная статистика. Тогда положим

— достаточная статистика. Тогда положим

не зависит от  в силу достаточности

в силу достаточности  ,

,

откуда

Достаточность. Пусть  . Тогда

. Тогда

не зависит от  , поэтому

, поэтому  — достаточная статистика.

— достаточная статистика.

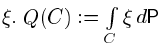

Условное математическое ожидание

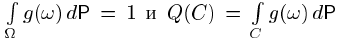

Определение. Пусть  — вероятностное пространство,

— вероятностное пространство,  -измеримая функция (случайная величина),

-измеримая функция (случайная величина),  -подалгебра в

-подалгебра в  . Тогда условным математическим ожиданием (УМО; обозначение:

. Тогда условным математическим ожиданием (УМО; обозначение:

относительно

относительно  (более точно, вариантом УМО) называется случайная величина

(более точно, вариантом УМО) называется случайная величина  удовлетворяющая следующим условиям:

удовлетворяющая следующим условиям:

-измерима;

-измерима;- для всех

Замечание.  не обязана быть

не обязана быть  -измеримой (иначе определение тривиально: возьмём

-измеримой (иначе определение тривиально: возьмём  ). УМО есть осреднение случайной величины, чтобы та стала измеримой относительно более грубой

). УМО есть осреднение случайной величины, чтобы та стала измеримой относительно более грубой  -алгебры.

-алгебры.

Следующие два утверждения обосновывают корректность определения: Утверждение 2.15. Варианты. УМО существуют, если  .

.

□ Сначала рассмотрим случай неотрицательной случайной величины

определяет меру на  абсолютно непрерывную относительно меры

абсолютно непрерывную относительно меры  . рассмотренной па

. рассмотренной па  . По теореме Радона- Никодима существует

. По теореме Радона- Никодима существует  -измеримая функция

-измеримая функция  такая, что

такая, что

( — производная Радона-Никодима).

— производная Радона-Никодима).  по определению является вариантом УМО.

по определению является вариантом УМО.

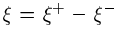

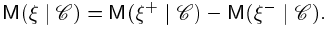

В случае знакопеременной  полагаем

полагаем  (

( и

и  неотрицательны) и берём в качестве варианта УМО

неотрицательны) и берём в качестве варианта УМО

Замечание. Условие  не является необходимым.

не является необходимым.

Утверждение 2.16. Любые два варианта УМО совпадают, почти наверное.

□ От противного: пусть  и

и  — два варианта УМО

— два варианта УМО  . Пусть также

. Пусть также

Имеем, что

где

Хотя бы одно из множеств  имеет положительную меру (иначе

имеет положительную меру (иначе  ); без ограничения общности считаем

); без ограничения общности считаем  . ■ Тогда по определению варианта УМО

. ■ Тогда по определению варианта УМО

что противоречит тому, что  всюду па

всюду па  и

и  . ■

. ■

Поэтому УМО можно считать однозначно определённым с точностью до множеств  -меры нуль. Определение. Пусть

-меры нуль. Определение. Пусть  — вероятностное пространство,

— вероятностное пространство,  -подалгебра в

-подалгебра в  . Тогда условная вероятность

. Тогда условная вероятность  относительно определяется так:

относительно определяется так:

где  — характеристическая функция

— характеристическая функция  .

.

Определение. Пусть  — вероятностное пространство.

— вероятностное пространство.  и

и  — случайные величины,

— случайные величины,  -подалгебра в

-подалгебра в  , порождённая

, порождённая  (т. е. прообразы всех борелевских множеств из

(т. е. прообразы всех борелевских множеств из  ). Тогда условным матожиданием

). Тогда условным матожиданием  относительно

относительно  называется

называется

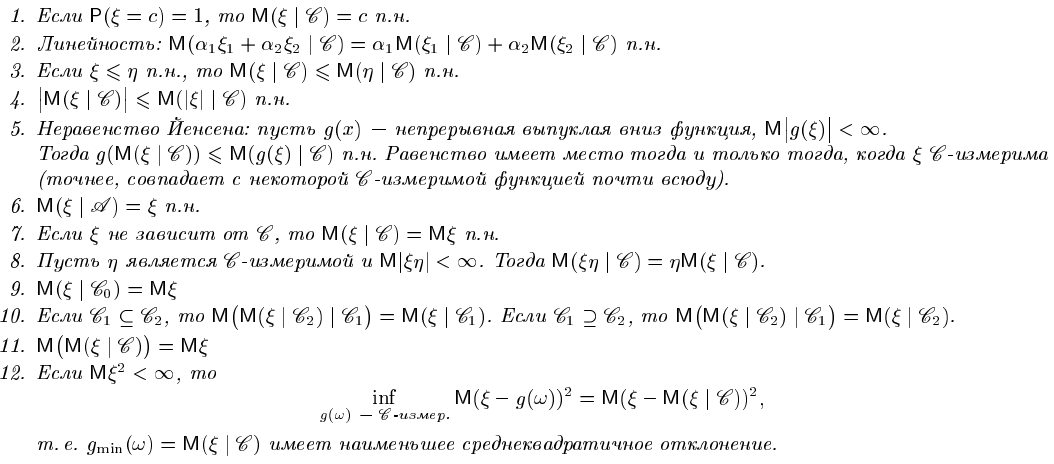

Свойства УМО

Определение.  не зависит, от

не зависит, от  -алгебры

-алгебры  , если для любого события

, если для любого события  случайные величины

случайные величины  и

и  независимы.

независимы.

Обозначение:  — тривиальная

— тривиальная  -алгебра. Утверждение 2.17.

-алгебра. Утверждение 2.17.

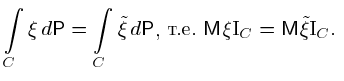

Теорема Колмогорова —Блекуэлла —Рао

— параметрическая модель.

— параметрическая модель.  — достаточная статистика, если существует вариант регулярной условной вероятности

— достаточная статистика, если существует вариант регулярной условной вероятности  , не зависящий от параметра

, не зависящий от параметра  .

.

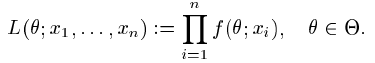

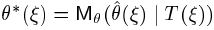

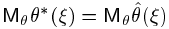

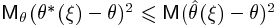

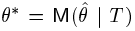

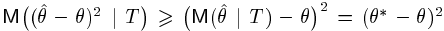

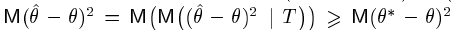

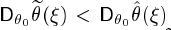

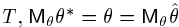

Теорема 2.18 (Колмогоров —Блекуэлл —Рао). Пусть  — достаточная статистика;

— достаточная статистика;  — оценка параметра

— оценка параметра  с

с  . Тогда оценка

. Тогда оценка  обладает следующими свойствами:

обладает следующими свойствами:

,

, . Равенство имеет, место тогда и только тогда, когда

. Равенство имеет, место тогда и только тогда, когда  измерима относительно

измерима относительно  (является измеримой функцией достаточной статистики).

(является измеримой функцией достаточной статистики).

□ В силу определения достаточной статистики  не зависит от

не зависит от  , поэтому

, поэтому  — статистика.

— статистика.  измерима (в силу определения УМО), поэтому

измерима (в силу определения УМО), поэтому  есть функция от

есть функция от  В силу неравенства Йенсена

В силу неравенства Йенсена  . Возьмём математическое ожидание:

. Возьмём математическое ожидание:  , причём равенство в неравенстве Иеисеиа достигается тогда и только тогда, когда

, причём равенство в неравенстве Иеисеиа достигается тогда и только тогда, когда  -измерима, т.е. есть функция от

-измерима, т.е. есть функция от  .

.

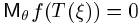

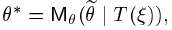

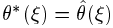

Полная достаточная статистика

Определение. Достаточная статистика  называется полной (для данного параметрического семейства распределений), если для любой измеримой функции

называется полной (для данного параметрического семейства распределений), если для любой измеримой функции  при любом значении параметра из условия

при любом значении параметра из условия  следует, что

следует, что  почти наверное.

почти наверное.

Полная достаточная статистика  обладает следующим свойством: если

обладает следующим свойством: если

то  почти наверное. Доказательство очевидно.

почти наверное. Доказательство очевидно.

Теорема 2.19. Пусть  — полная достаточная статистика и

— полная достаточная статистика и  и

и  таковы, что

таковы, что  . Тогда

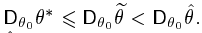

. Тогда  является эффективной оценкой для

является эффективной оценкой для  .

.

□ Докажем теорему в частном случае  .

.

Дано, что

т.е.

несмещённая оценка параметра  . Докажем, что эта оценка имеет наименьшую дисперсию среди всех возможных несмещённых оценок. От противного. Пусть существует такая оценка

. Докажем, что эта оценка имеет наименьшую дисперсию среди всех возможных несмещённых оценок. От противного. Пусть существует такая оценка  , что

, что  (

( — несмещённая оценка) и

— несмещённая оценка) и

хотя бы для одного

Улучшим оценку  при помощи теоремы Колмогорова-Блекуэлла-Рао:

при помощи теоремы Колмогорова-Блекуэлла-Рао:

причём

Имеем:

Но  и

и  суть функции полной достаточной статистики

суть функции полной достаточной статистики  , откуда

, откуда  почти наверное, а поэтому

почти наверное, а поэтому  . Противоречие. ■ Замечание. Полная достаточная статистика существует не всегда.

. Противоречие. ■ Замечание. Полная достаточная статистика существует не всегда.

Замечания о минимальной достаточной статистике

- Любая измеримая взаимно-однозначная функция от достаточной статистики сама является достаточной статистикой.

- Если для любой достаточной статистики

существует такая измеримая взаимно-однозначная функция

существует такая измеримая взаимно-однозначная функция  , что

, что  . то

. то  называется минимальной достаточной статистикой. Минимальная достаточная статистика существует всегда (для любой параметрической модели). Можно проводить редукцию (без потери информации) от выборки к минимальной достаточной статистике. Дальнейшая редукция невозможна.

называется минимальной достаточной статистикой. Минимальная достаточная статистика существует всегда (для любой параметрической модели). Можно проводить редукцию (без потери информации) от выборки к минимальной достаточной статистике. Дальнейшая редукция невозможна. - Как правило, в разложении, которое даёт теорема Неймана-Фишера, появляется минимальная достаточная статистика.

- Полная достаточная статистика (если она существует) является минимальной.

Возможно эти страницы вам будут полезны:

- Предмет теория вероятностей и математическая статистика Решение задач по теории вероятностей

- Помощь по теории вероятности

- Заказать работу по теории вероятности

- Контрольная работа по теории вероятности

- Курсовая работа по теории вероятности

- Решение задач по математической статистике

- Помощь по математической статистике

- Заказать работу по математической статистике

- Курсовая работа по математической статистике

- Теория вероятностей краткий курс для школьников и студентов