Оглавление:

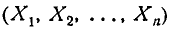

В практических применениях теории вероятностей очень часто приходится сталкиваться с задачами, в которых результат опыта описывается не одной случайной величиной, а двумя или более случайными величинами, образующими комплекс или систему. Например, точка попадания снаряда определяется не одной случайной величиной, а двумя: абсциссой и ординатой — и может быть рассмотрена как комплекс двух случайных величин. Аналогично точка разрыва дистанционного снаряда определяется комплексом трех случайных величин. При стрельбе группой из n выстрелов совокупность точек попадания на плоскости может рассматриваться как комплекс или система 2n случайных величин: n абсцисс и n ординат точек попадания. Осколок, образовавшийся при разрыве снаряда, характеризуется рядом случайных величин: весом, размерами, начальной скоростью, направлением полета и т. д. Условимся систему нескольких случайных величин X, Y ,…,W обозначать (X, Y,…, W).

Свойства системы нескольких случайных величин не исчерпываются свойствами отдельных величин, её составляющих: помимо этого, они включают также взаимные связи (зависимости) между случайными величинами.

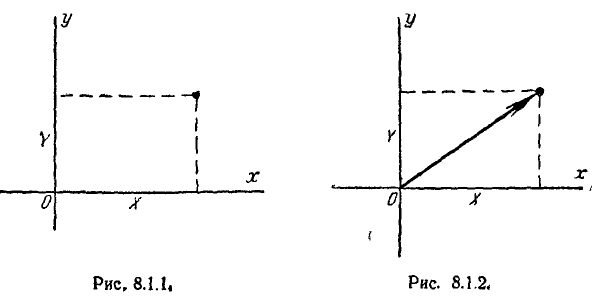

При рассмотрении вопросов, связанных с системами случайных величин, удобно пользоваться геометрической интерпретацией системы. Например, систему двух случайных величин (X, Y) можно изображать случайной точкой на плоскости с координатами X и Y (рис. 8.1.1), Аналогично система трёх случайных величин может быть изображена случайной точкой в трёхмерном пространстве. Часто бывает удобно говорить о системе n случайных величин как о «случайной точке в пространстве n измерений». Несмотря на то, что последняя интерпретация не обладает непосредственной наглядностью, пользование ею даёт некоторый выигрыш в смысле общности терминологии и упрощения записей.

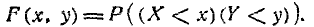

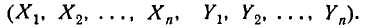

Часто вместо образа случайной точки для геометрической интерпретации системы случайных величин пользуются образом случайного вектора. Систему двух случайных величин при этом рассматривают как случайный вектор на плоскости хОу, составляющие которого по осям представляют собой случайные величины X, Y (рис. 8.1.2). Система трёх случайных величин изображается случайным вектором в трёхмерном пространстве, система n случайных величин —

случайным вектором в пространстве п измерений. При этом теория систем случайных величин рассматривается как теория случайных векторов.

В данном курсе мы будем в зависимости от удобства изложения пользоваться как одной, так и другой интерпретацией.

Занимаясь системами случайных величин, мы будем рассматривать как полные, исчерпывающие вероятностные характеристики — законы распределения, так и неполные — числовые характеристики.

Изложение начнем с наиболее простого случая системы двух случайных величин.

Функция распределения системы двух случайных величин

Функцией распределения системы двух случайных величин (X, Y) называется вероятность совместного выполнения двух неравенств Х<х и У<у:  (8.2.1)

(8.2.1)

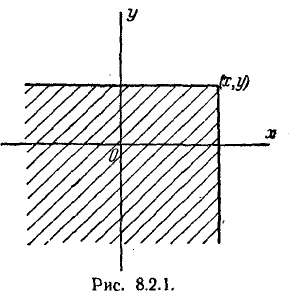

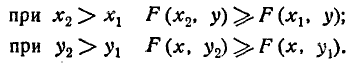

Если пользоваться для геометрической интерпретации системы образом случайной точки, то функция распределения F(x, у) есть не что иное, как вероятность попадании случайной точки (X, Y) в бесконечный квадрант с вершиной в точке (х, у), лежащий левее и ниже ее (рис. 8.2.1). В аналогичной интерпретации функция распределения одной случайной величины X — обозначим её  — представляет собой вероятность попадания случайной точки в полуплоскость, ограниченную справа абсциссой х (рис. 8.2.2); функция распределения одной величины Y —

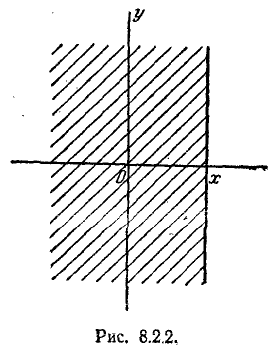

— представляет собой вероятность попадания случайной точки в полуплоскость, ограниченную справа абсциссой х (рис. 8.2.2); функция распределения одной величины Y —  — вероятность попадания в полуплоскость, ограниченную сверху ординатой у (рис. 8.2.3).

— вероятность попадания в полуплоскость, ограниченную сверху ординатой у (рис. 8.2.3).

В п°5.2 мы привели основные свойства функции распределения F(х) для одной случайной величины. Сформулируем аналогичные свойства для функции распределения системы случайных величин и снова воспользуемся геометрической интерпретацией для наглядной иллюстрации этих свойств.

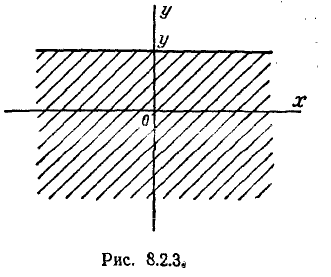

Функция распределения F(x, у) есть неубывающая функция обоих своих аргументов, т. е.

В этом свойстве функции F (х) можно наглядно убедиться, пользуясь геометрической интерпретацией. функции распределения как вероятности попадания в квадрант с вершиной (х, у) (рис. 8.2.1). Действительно, увеличивая х (смещая правую границу квадранта вправо) или увеличивая у (смещая верхнюю границу вверх), мы, очевидно, не можем уменьшить вероятность попадания в этот квадрант.

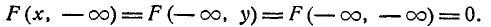

Повсюду на  функция распределения равна нулю:

функция распределения равна нулю:

В этом свойстве мы наглядно убеждаемся, неограниченно отодвигая влево правую границу квадранта  или вниз его верхнюю границу

или вниз его верхнюю границу  или делая это одновременно с обеими границами; при этом вероятность попадания в квадрант стремится к нулю.

или делая это одновременно с обеими границами; при этом вероятность попадания в квадрант стремится к нулю.

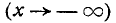

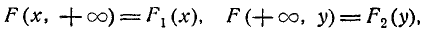

3.При одном из аргументов, равном  функция распределения системы превращается в функцию распределения случайной величины, соответствующей другому аргументу:

функция распределения системы превращается в функцию распределения случайной величины, соответствующей другому аргументу:

где  ,

, — соответственно функции распределения случайных величин X и Y.

— соответственно функции распределения случайных величин X и Y.

В этом свойстве функции распределения можно наглядно убедиться, смещая ту или иную из границ квадранта на  при этом в пределе квадрант превращается в полуплоскость, вероятность попадания в которую есть функция распределения одной из величин, входящих в систему.

при этом в пределе квадрант превращается в полуплоскость, вероятность попадания в которую есть функция распределения одной из величин, входящих в систему.

4.Если оба аргумента равны  функция распределения системы равна единице:

функция распределения системы равна единице:

Действительно, при  квадрант с вершиной (х, у) в пределе обращается во всю плоскость хОу, попадание в которую есть достоверное событие. При рассмотрении законов распределения отдельных случайных величин (глава 5) мы вывели выражение для вероятности попадания случайной величины в пределы заданного участка. Эту вероятность мы выразили как через функцию распределения, так и через плотность распределения.

квадрант с вершиной (х, у) в пределе обращается во всю плоскость хОу, попадание в которую есть достоверное событие. При рассмотрении законов распределения отдельных случайных величин (глава 5) мы вывели выражение для вероятности попадания случайной величины в пределы заданного участка. Эту вероятность мы выразили как через функцию распределения, так и через плотность распределения.

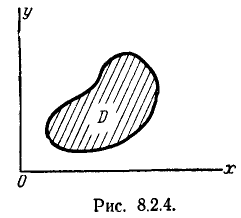

Аналогичным вопросом для системы двух случайных величин является вопрос о вероятности попадания случайной точки (X.Y) в пределы заданной области D на плоскости хОу (рис. 8.2.4).

Условимся событие, состоящее в попадании случайной точки (Х, Y) в область D, обозначать символом

Вероятность попадания случайной точки в заданную область выражается наиболее просто в том случае, когда эта область представляет собой прямоугольник со сторонами, параллельными координатным осям.

Вероятность попадания случайной точки в заданную область выражается наиболее просто в том случае, когда эта область представляет собой прямоугольник со сторонами, параллельными координатным осям.

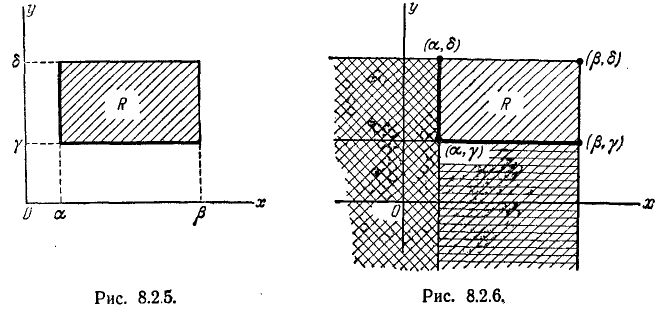

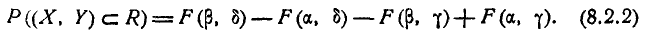

Выразим через функцию распределения системы вероятность по- попадания случайной точки (X, Y) в прямоугольник R, ограничен- ограниченный абсциссами а и и ординатами

и ординатами  и

и  (рис. 8.2.5).

(рис. 8.2.5).

При этом следует условиться, куда мы будем относить границы прямоугольника. Аналогично тому, как мы делали для одной случайной величины, условимся включать в прямоугольник R его нижнюю и левую границы и не включать верхнюю и правую  Тогда событие

Тогда событие  будет равносильно произведению двух событий:

будет равносильно произведению двух событий:  и

и  Выразим вероятность этого события через

Выразим вероятность этого события через

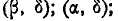

функцию распределения системы. Для этого рассмотрим на плоскости хОу четыре бесконечных квадранта с вершинами в точках

и

и  (Рис- 8.2.6).

(Рис- 8.2.6).

Очевидно, вероятность попадания в прямоугольник R равна вероятности попадания в квадрант  минус вероятность попадания в квадрант

минус вероятность попадания в квадрант  минус вероятность попадания в квадрант

минус вероятность попадания в квадрант  плюс вероятность попадания в квадрант

плюс вероятность попадания в квадрант  (так как мы дважды вычли вероятность попадания в этот квадрант). Отсюда получаем формулу, выражающую вероятность попадания в прямоугольник через функцию распределения системы:

(так как мы дважды вычли вероятность попадания в этот квадрант). Отсюда получаем формулу, выражающую вероятность попадания в прямоугольник через функцию распределения системы:

В дальнейшем, когда будет введено понятие плотности распределения системы, мы выведем формулу для вероятности попадания случайной точки в область произвольной формы.

На рис. 8.2.5 границы, включенные в прямоугольник, даны жирными линиями.

На рис. 8.2.5 границы, включенные в прямоугольник, даны жирными линиями.

Плотность распределения системы двух случайных величин

Введенная в предыдущем п° характеристика системы — функция распределения — существует для систем любых случайных величин, как прерывных, так я непрерывных. Основное практическое значение имеют системы непрерывных случайных величин. Распределение системы непрерывных величин обычно характеризуют не функцией распределения, а плотностью распределения.

Вводя в рассмотрение плотность распределения для одной случайной величины, мы определяли её как предел отношения вероятности попадания на малый участок к длине этого участка при её неограниченном уменьшении. Аналогично определим плотность распределения системы двух величин.

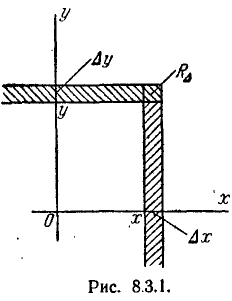

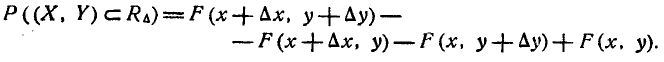

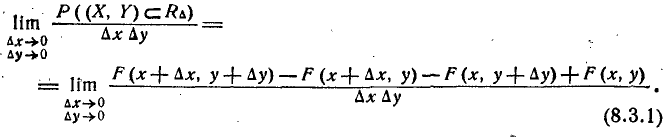

Пусть имеется система двух непрерывных случайных величин (X, Y), которая интерпретируется случайной точкой на плоскости хОу. Рассмотрим на этой плоскости малый прямоугольник  со сторонами

со сторонами  и

и  , примыкающий к точке с координатами (х, у) (рис. 8.3.1). Вероятность попадания в этот прямоугольник по формуле (8.2.2) равна

, примыкающий к точке с координатами (х, у) (рис. 8.3.1). Вероятность попадания в этот прямоугольник по формуле (8.2.2) равна

Разделим вероятность попадания в прямоугольник  на площадь этого прямоугольника и перейдем к пределу при

на площадь этого прямоугольника и перейдем к пределу при  и

и

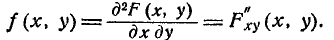

Предположим, что функция F(x, у) не только непрерывна, но и дифференцируема; тогда правая часть формулы (8.3.1) представляет собой вторую смешанную частную производную функции F (х, у) по х и у. Обозначим эту производную f(.г. у):

Функция f (х, у) называется плотностью распределения системы.

Таким образом, плотность распределения системы представляет собой предел отношения вероятности попадания в малый прямоугольник к площади этого прямоугольника, когда оба его размера стремятся к нулю; она может быть выражена как вторая смешанная частная производная функции распределения системы по обоим аргументам.

Если воспользоваться «механической» интерпретацией распределения системы как распределения единичной массы по плоскости хОу, функция f(x, у) представляет собой плотность распределения массы в точке (х, у).

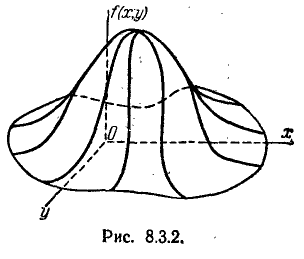

Геометрически функцию f(x, у) можно изобразить некоторой поверхностью (рис. 8.3.2). Эта поверхность аналогична кривой рас- распределения для одной случайной величины и называется поверхностью распределения.

Если пересечь поверхность распределения f(x, у) плоскостью, параллельной плоскости хОу, и спроектировать полученное сечение на плоскость хОу, получится кривая, в каждой точке которой плотность распределения постоянна. Такие кривые называются кривыми равной плотности. Кривые равной плотности, очевидно, представляют собой горизонтали поверхности распределения Часто бывает удобно задавать распределение семейством кривых равной плотности.

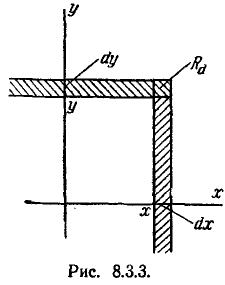

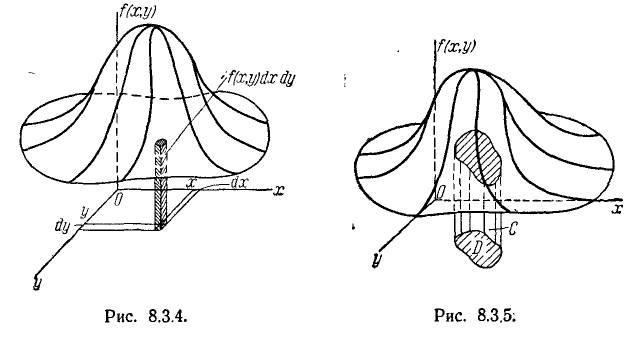

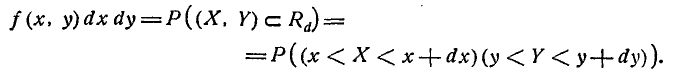

Рассматривая плотность распределения f (х) для одной случайной величины, мы ввели понятие «элемента вероятности» f(x)dx. Это есть вероятность попадания случайной величины X на элементарный участок dx, прилежащий к точке х. Аналогичное понятие «элемента вероятности» вводится и для системы двух случайных величин. Элементом вероятности в данном случае называется выражение

f(x, y)dx dy.

Очевидно, элемент вероятности есть не что иное, как вероятность попадания в элементарный прямоугольник со сторонами dx,dy примыкающий к точке (х, у) (рис. 8.3.3). Эта вероятность равна объему элементарного параллелепипеда, ограниченного сверху поверхностью f(x, у) и опирающегося на элементарный прямоугольник dx dy (рис. 8.3.4).

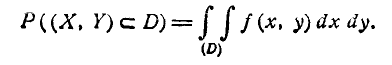

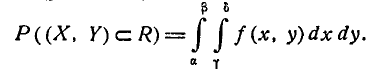

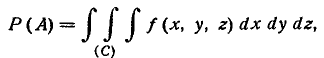

Пользуясь понятием элемента вероятности, выведем выражение для вероятности попадания случайной точки в произвольную область D. Эта вероятность, очевидно, может быть получена суммированием (интегрированием) элементов вероятности по всей области D:

(8.3.3)

(8.3.3)

Геометрически вероятность попадания в область D изображается объемом цилиндрического тела С, ограниченного сверху поверхностью распределения и опирающегося на область D (рис. 8.3.5).

Из общей формулы (8.3.3) вытекает формула для вероятности попадания в прямоугольник R, ограниченный абсциссами а и  и ординатами

и ординатами  и

и  (рис. 8.2.5):

(рис. 8.2.5):

(8.3.4)

(8.3.4)

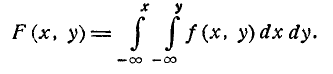

Воспользуемся формулой (8.3.4) для того, чтобы выразить функцию распределения системы F(x, у) через плотность распределения f(x, у). Функция распределения F(x, у) есть вероятность попадания в бесконечный квадрант; последний можно рассматривать как прямоугольник, ограниченный абсциссами  и х и ординатами

и х и ординатами  и у. По формуле (8.3.4) имеем:

и у. По формуле (8.3.4) имеем:

Легко убедиться в следующих свойствах плотности распределения системы:

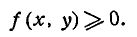

1.Плотность распределения системы есть функция неотрицательная:

Это ясно из того, что плотность распределения есть предел отношения двух неотрицательных величин: вероятности попадания в прямоугольник и площади прямоугольника — и, следовательно, отрицательной быть не может.

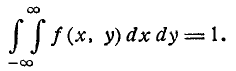

2.Двойной интеграл в бесконечных пределах от плотности распределения системы равен единице:

(8.3.6)

(8.3.6)

Это видно из того, что интеграл (8.3.6) есть не что иное, как вероятность попадания во всю плоскость хОу, т. е. вероятность достоверного события.

Геометрически это свойство означает, что полный объем тела, ограниченного поверхностью распределения и плоскостью хОу, равен единице.

Пример:

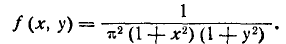

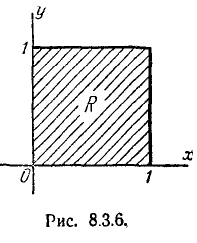

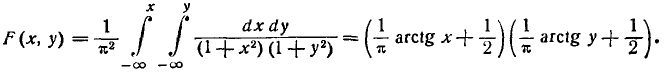

Система двух случайных величин (X, У) подчинена закону распределения с плотностью

Найти функцию распределения F (х, у). Определить вероятность попадания случайной точки (X, У) в квадрат R (рис. 8.3.6).

Решение:

Функцию распределения F (х, у) находим по формуле (8.3.5).

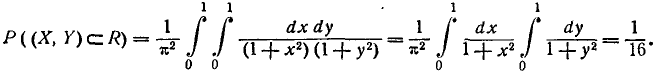

Вероятность попадания в прямоугольник R находим по формуле (8.3.4):

Пример:

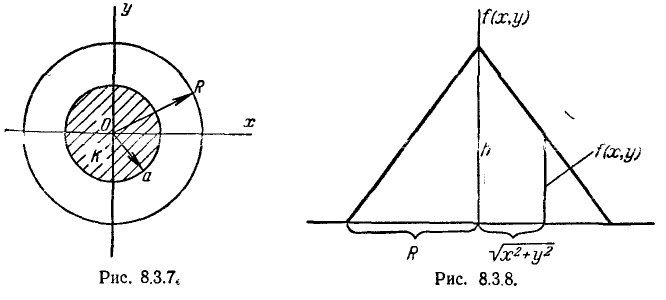

Поверхность распределения системы (X, У) представляет собой прямой круговой конус, основанием которого служит круг радиуса R

с центром в начале координат. Написать выражение плотности распределения. Определить вероятность того, что случайная точка (х, у) попадет в круг К радиуса а (рис. 8.3.7), причем а < R.

Решение:

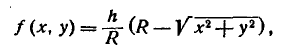

Выражение плотности распределения внутри круга К находим из рис. 8.3.8:

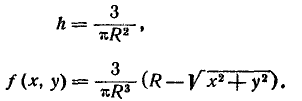

где h — высота конуса. Величину h определяем так, чтобы объем конуса был равен единице:

откуда

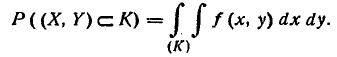

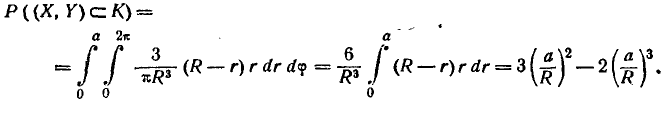

Вероятность попадания в круг К определяем по формуле (8.3.4):  (8.3.7)

(8.3.7)

Для вычисления интеграла (8.3.7) удобно перейти к полярной системе координат

Законы распределения отдельных величии, входящих в систему. Условные законы распределения

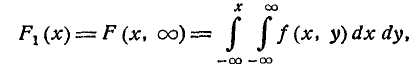

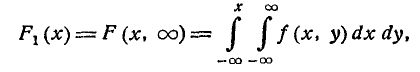

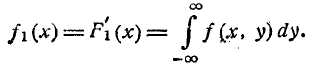

Зная закон распределения системы двух случайных величин, можно всегда определить законы распределения отдельных величин, входящих в систему. В п° 8.2 мы уже вывели выражения для функций распределения отдельных величин, входящих в систему, через функцию распределения системы, а именно, мы показали, что  (8.4.1)

(8.4.1)

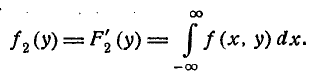

Выразим теперь плотность распределения каждой из величин, входящих в систему, через плотность распределения системы. Пользуясь формулой (8.3.5), выражающей функцию распределения через плотность распределения, напишем:

откуда, дифференцируя по х, получим выражение для плотности распределения величины X:

(8.4.2)

(8.4.2)

Аналогично

(8.4.3)

(8.4.3)

Таким образом, для того чтобы получить плотность распределения одной из величин, входящих в систему, нужно плотность распределения системы проинтегрировать в бесконечных пределах по аргументу, соответствующему другой случайной величине.

Формулы (8.4.1), (8.4.2) и (8.4.3) дают возможность, зная закон распределения системы (заданный в виде функции распределения или плотности распределения), найти законы распределения отдельных величин, входящих в систему. Естественно, возникает вопрос об обратной задаче: нельзя ли по законам распределения отдельных величин, входящих в систему, восстановить закон распределения системы? Оказывается, что в общем случае этого сделать нельзя: зная только законы распределения отдельных величин, входящих в систему, не всегда можно найти закон распределения системы. Дли того чтобы исчерпывающим образом охарактеризовать систему, недостаточно знать распределение каждой из величин, входящих в систему; нужно еще знать зависимость между величинами, входящими в систему. Эта зависимость может быть охарактеризована с помощью так на- называемых условных законов распределения.

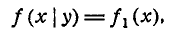

Условным законом распределения величины X, входящей в систему (X, Y), называется ее закон распределения, вычисленный при условии, что другая случайная величина Y приняла определенное значение у.

Условный закон распределения можно задавать как функцией распределения, так и плотностью. Условная функция распределения обозначается  , условная плотность распределения

, условная плотность распределения  Так как системы непрерывных величин имеют основное практическое значение, мы в данном курсе ограничимся рассмотрением условных законов, заданных плотностью распределения.

Так как системы непрерывных величин имеют основное практическое значение, мы в данном курсе ограничимся рассмотрением условных законов, заданных плотностью распределения.

Чтобы нагляднее пояснить понятие условного закона распределения, рассмотрим пример. Система случайных величин L и Q представляет собой длину и вес осколка снаряда. Пусть нас интересует длина осколка L безотносительно к его весу; это есть случайная величина, подчиненная закону распределения с плотностью  . Этот закон распределения мы можем исследовать, рассматривая все без исключения осколки и оценивая их только по длине;

. Этот закон распределения мы можем исследовать, рассматривая все без исключения осколки и оценивая их только по длине;  есть безусловный закон распределения длины осколка. Однако нас может интересовать и закон распределения длины осколка вполне определенного веса, например 10 г. Для того чтобы его определить, мы будем исследовать не все осколки, а только определенную весовую группу, в которой вес приблизительно равен 10 г, и получим условный закон распределения длины осколка при весе 10 г с плотностью

есть безусловный закон распределения длины осколка. Однако нас может интересовать и закон распределения длины осколка вполне определенного веса, например 10 г. Для того чтобы его определить, мы будем исследовать не все осколки, а только определенную весовую группу, в которой вес приблизительно равен 10 г, и получим условный закон распределения длины осколка при весе 10 г с плотностью при q=10. Этот условный закон распределения вообще отличается от безусловного

при q=10. Этот условный закон распределения вообще отличается от безусловного  ; очевидно, более тяжелые осколки должны в среднем обладать и большей длиной; следовательно, условный закон распределения длины осколка существенно зависит от веса q.

; очевидно, более тяжелые осколки должны в среднем обладать и большей длиной; следовательно, условный закон распределения длины осколка существенно зависит от веса q.

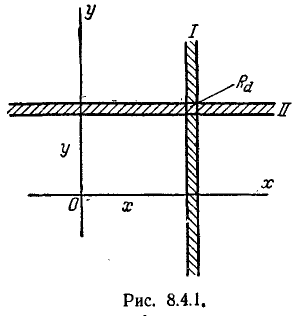

Зная закон распределения одной из величин, входящих в систему, и условный закон распределения второй, можно составить закон распределения системы. Выведем формулу, выражающую это соотношение, для непрерывных случайных величин. Для этого воспользуемся понятием об элементе вероятности. Рассмотрим прилежащий к точке (х, у) элементарный прямоугольник  со сторонами dx, dy (рис. 8.4.1). Вероятность попадания в этот прямоугольник— элемент вероятности f(x, у) dx dy — равна вероятности одновременного попадания случайной точки (X, Y) в элементарную полосу /, опирающуюся на отрезок dx, и в полосу //, опирающуюся на отрезок dy:

со сторонами dx, dy (рис. 8.4.1). Вероятность попадания в этот прямоугольник— элемент вероятности f(x, у) dx dy — равна вероятности одновременного попадания случайной точки (X, Y) в элементарную полосу /, опирающуюся на отрезок dx, и в полосу //, опирающуюся на отрезок dy:

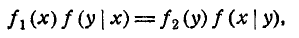

Вероятность произведения этих двух событий, по теореме умножения вероятностей, равна вероятности попадания в элементарную полосу /, умноженной на условную вероятность попадания в элементарную полосу //, вычисленную при условии, что первое событие имело место. Это условие в пределе равносильно условию Х = х; следовательно,

откуда

(8.4.4)

(8.4.4)

т. е. плотность распределения системы двух величин равна плотности распределения одной из величин, входящих в систему, умноженной на условную плотность распределения другой величины, вычисленную при условии, что первая величина приняла заданное значение.

Формулу (8.4.4) часто называют теоремой умножения законов распределения. Эта теорема в схеме случайных величин аналогична теореме умножения вероятностей в схеме событий.

Очевидно, формуле (8.4.4) можно придать другой вид, если за- задать значение не величины X, а величины Y:

(8.4.5)

(8.4.5)

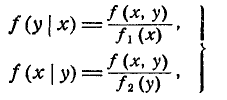

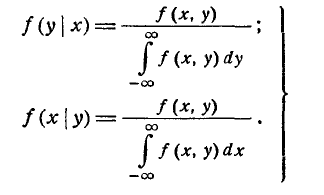

Разрешая формулы (8.4.4) и (8.4.5) относительно f(y\x) и f(x\y), получим выражения условных законов распределения через безусловные:

(8.4.6)

(8.4.6)

или, применяя формулы (8.4.2) и (8.4.3),

(8.4.7)

(8.4.7)

Зависимые и независимые случайные величины

При изучении систем случайных величин всегда следует обращать внимание на степень и характер их зависимости. Эта зависимость может быть более или менее ярко выраженной, более или менее тесной. В некоторых случаях зависимость между случайными величинами может быть настолько тесной, что, зная значение одной случайной величины, можно в точности указать значение другой. В другом крайнем случае зависимость между случайными величинами является настолько слабой и отдаленной, что их можно практически считать независимыми.

Понятие о независимых случайных величинах — одно из важных понятий теории вероятностей.

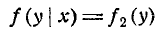

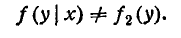

Случайная величина Y называется независимой от случайной величины X, если закон распределения величины Y не зависит от того, какое значение приняла величина X.

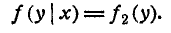

Для непрерывных случайных величин условие независимости К от X может быть записано в виде:

при любом у. Напротив, в случае, если Y зависит от Х, то

Докажем, что зависимость или независимость случайных величин всегда взаимны: если величина Y не зависит от X, то и величина X не зависит от Y.

Действительно, пусть Y не зависит от X:

(8.5.1)

(8.5.1)

Из формул (8.4.4) и (8.4.5) имеем:

откуда, принимая во внимание (8.5.1), получим:

что и требовалось доказать.

Так как зависимость и независимость случайных величин всегда взаимны, можно дать новое определение независимых случайных величин.

Случайные величины X и Y называются независимыми, если закон распределения каждой из них не зависит от того, какое значение приняла другая. В противном случае величины X и Y называются зависимыми.

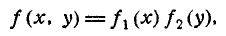

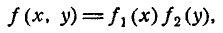

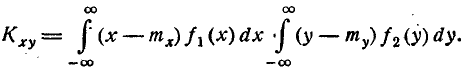

Для независимых непрерывных случайных величин теорема умножения законов распределения принимает вид:  (8.5.2)

(8.5.2)

т. е. плотность распределения системы независимых случайных величин равна произведению плотностей распределения отдельных величин, входящих в систему.

Условие (8.5.2) может рассматриваться как необходимое и достаточное условие независимости случайных величин.

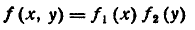

Часто по самому виду функции f(x, у) можно заключить, что случайные величины X, Y являются независимыми, а именно, если плотность распределения f(x, у) распадается на произведение двух функций, из которых одна зависит только от х, другая — только от у, то случайные величины независимы.

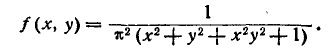

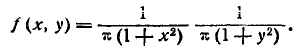

Пример. Плотность распределения системы (X, Y) имеет вид:

Определить: зависимы или независимы случайные величины X и Y. Решение. Разлагая знаменатель на множители, имеем:

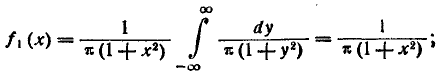

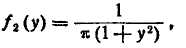

Из того, что функция f(х, у) распалась на произведение двух функций из которых одна зависит только от х, а другая — только от у, заключаем, что величины X и К должны быть независимы. Действительно, применяя формулы (8.4.2) и (8.4.3), имеем:

аналогично

откуда убеждаемся, что

и, следовательно, величины X и Y независимы.

Вышеизложенный критерий суждения о зависимости или независимости случайных величин исходит из предположения, что закон распределения системы нам известен. На практике чаще бывает наоборот: закон распределения системы (Х, У) не известен; известны только законы распределения отдельных величин, входящих в систему, и имеются основания считать, что величины Х и У независимы. Тогда можно написать плотность распределения системы как произведение плотностей распределения отдельных величин, входящих в систему.

Остановимся несколько подробнее на важных понятиях о «зависимости» и «независимости» случайных величин.

Понятие «зависимости» случайных величин, которым мы пользуемся в теории вероятностей, несколько отличается от обычного понятия «зависимости» величин, которым мы оперируем в математике. Действительно, обычно под «зависимостью» величин подразумевают только один тип зависимости — полную, жесткую, так называемую функциональную зависимость. Две величины X и Y называются функционально зависимыми, если, зная значение одной из них, можно точно указать значение другой.

В теории вероятностей мы встречаемся с другим, более общим, типом зависимости — с вероятностной или «стохастической» зависимостью. Если величина Y связана с величиной X вероятностной зависимостью, то, зная значение X, нельзя указать точно значение Y, а можно указать только ее закон распределения, зависящий от того, какое значение приняла величина X.

Вероятностная зависимость может быть более или менее тесной; по мере увеличения тесноты вероятностной зависимости она все более приближается к функциональной. Таким образом, функциональную зависимость можно рассматривать как крайний, предельный случай наиболее тесной вероятностной зависимости. Другой крайний случай — полная независимость случайных величин. Между этими двумя крайними случаями лежат все градации вероятностной зависимости — от самой сильной до самой слабой. Те физические величины, которые на практике мы считаем функционально зависимыми, в действительности связаны весьма тесной вероятностной зависимостью: при заданном значении одной из этих величин другая колеблется в столь узких пределах, что ее практически можно считать вполне определенной. С другой стороны, те величины, которые мы на практике считаем независимыми, в действительности часто находятся в некоторой взаимной зависимости, но эта зависимость настолько слаба, что ею для практических целей можно пренебречь.

Вероятностная зависимость между случайными величинами очень часто встречается на практике. Если случайные величины X и Y находятся в вероятностной зависимости, это не означает, что с изменением величины X величина Y изменяется вполне определенным образом; это лишь означает, что с изменением величины X величина Y имеет тенденцию также изменяться (например, возрастать или убывать при возрастании X). Эта тенденция соблюдается лишь «в среднем», в общих чертах, и в каждом отдельном случае от нее возможны отступления.

Рассмотрим, например, две такие случайные величины: X — рост наугад взятого человека, Y — его вес. Очевидно, величины X и У находятся в определенной вероятностной зависимости; она выражается в том, что в общем люди с большим ростом имеют больший вес. Можно даже составить эмпирическую формулу, приближенно заменяющую эту вероятностную зависимость функциональной. Такова, например, общеизвестная формула, приближенно выражающая зависимость между ростом и весом:

Y (кг) = Х (см)—100.

Формулы подобного типа, очевидно, не являются точными и выражают лишь некоторую среднюю, массовую закономерность, тенденцию, от которой в каждом отдельном случае возможны отступления.

В вышеприведенном примере мы имели дело со случаем явно выраженной зависимости. Рассмотрим теперь такие две случайные величины: X — рост наугад взятого человека; Z — его возраст. Очевидно, для взрослого человека величины X и Z можно считать практически независимыми; напротив, для ребенка величины X и Z являются зависимыми.

Приведем еще несколько примеров случайных величин, находящихся в различных степенях зависимости.

1.Из камней, составляющих кучу щебня, выбирается наугад один камень. Случайная величина Q — вес камня; случайная величина L — наибольшая длина камня. Величины Q и L находятся в явно выраженной вероятностной зависимости.

2. Производится стрельба ракетой в заданный район океана. Величина  — продольная ошибка точки попадания (недолет, перелет); случайная величина

— продольная ошибка точки попадания (недолет, перелет); случайная величина  — ошибка в скорости ракеты в конце активного участка движения. Величины

— ошибка в скорости ракеты в конце активного участка движения. Величины  и

и  явно зависимы, так как ошибка

явно зависимы, так как ошибка  является одной из главных причин, порождающих продольную ошибку

является одной из главных причин, порождающих продольную ошибку  .

.

3.Летательный аппарат, находясь в полете, измеряет высоту над поверхностью Земли с помощью барометрического прибора. Рассматриваются две случайные величины:  — ошибка измерения высоты и G — вес топлива, сохранившегося в топливных баках к моменту измерения. Величины

— ошибка измерения высоты и G — вес топлива, сохранившегося в топливных баках к моменту измерения. Величины  и G практически можно считать независимыми.

и G практически можно считать независимыми.

В следующем п° мы познакомимся с некоторыми числовыми характеристиками системы случайных величин, которые дадут нам возможность оценивать степень зависимости этих величин.

Числовые характеристики системы двух случайных величин. Корреляционный момент. Коэффициент корреляции

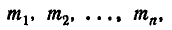

В главе 5 мы ввели в рассмотрение числовые характеристики одной случайной величины X— начальные и центральные моменты различных порядков. Из этих характеристик важнейшими являются две: математическое ожидание  и дисперсия

и дисперсия  .

.

Аналогичные числовые характеристики — начальные и центральные моменты различных порядков — можно ввести и для системы двух случайных величин.

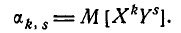

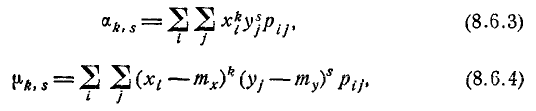

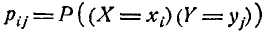

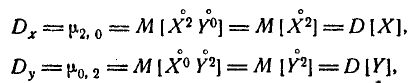

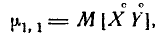

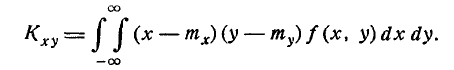

Начальным моментом порядка k, s системы (Х, Y) называется математическое ожидание произведения  на

на

(8.6.1)

(8.6.1)

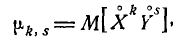

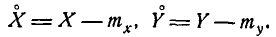

Центральным моментом порядка k, s системы (X, Y) называется математическое ожидание произведения k-й и s-й степени соответствующих центрированных величин:  (8.6.2)

(8.6.2)

где

Выпишем формулы, служащие для непосредственного подсчета моментов. Для прерывных случайных величин

где  — вероятность того, что система (X, Y) примет значения

— вероятность того, что система (X, Y) примет значения  а суммирование распространяется по всем возможным значениям случайных величин X, Y.

а суммирование распространяется по всем возможным значениям случайных величин X, Y.

Для непрерывных случайных величин:

где f(x, у) — плотность распределения системы. Помимо чисел k и s, характеризующих порядок момента по от- отношению к отдельным величинам, рассматривается ещё суммарный порядок момента k—s, равный сумме показателей степеней при Х и У. Соответственно суммарному порядку моменты классифицируются на первые, вторые и т. д. На практике обычно применяются только первые и вторые моменты.

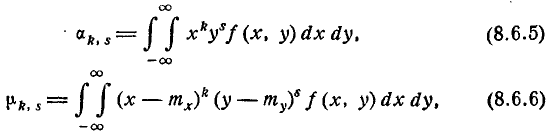

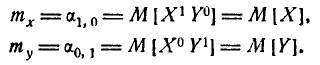

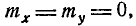

Первые начальные моменты представляют собой уже известные нам математические ожидания величин X и У, входящих в систему:

Совокупность математических ожиданий  ,

,  представляет собой характеристику положения системы. Геометрически это координаты средней точки на плоскости, вокруг которой происходит рассеивание точки (X, У).

представляет собой характеристику положения системы. Геометрически это координаты средней точки на плоскости, вокруг которой происходит рассеивание точки (X, У).

Кроме первых начальных моментов, на практике широко при- применяются ещё вторые центральные моменты системы. Два из них представляют собой уже известные нам дисперсии величин X и У:

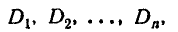

характеризующие рассеивание случайной точки в направлении осей Ох и Оу. Особую роль как характеристика системы играет второй смешанный центральный момент:

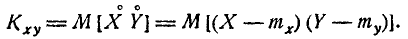

т. е. математическое ожидание произведения центрированных величин. Ввиду того, что этот момент играет важную роль в теории систем случайных величин, введем для него особое обозначение:  (8.6.7)

(8.6.7)

Характеристика  называется корреляционным моментом (иначе — «моментом связи») случайных величин X, У.

называется корреляционным моментом (иначе — «моментом связи») случайных величин X, У.

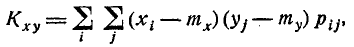

Для прерывных случайных величин корреляционный момент выражается формулой

(8.6.8)

(8.6.8)

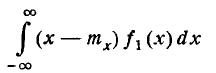

а для непрерывных — формулой

(8.6.9)

(8.6.9)

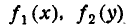

Выясним смысл и назначение этой характеристики. Корреляционный момент есть характеристика системы случайных величин, описывающая, помимо рассеивания величин X и Y, ещё и связь между ними. Для того чтобы убедиться в этом, докажем, что для независимых случайных величин корреляционный момент равен нулю.

Доказательство проведем для непрерывных случайных величин  . Пусть Х, У — независимые непрерывные величины с плотностью распределения f(x, у). В п° 8.5 мы доказали, что для независимых величин

. Пусть Х, У — независимые непрерывные величины с плотностью распределения f(x, у). В п° 8.5 мы доказали, что для независимых величин

(8.6.10)

(8.6.10)

где — плотности распределения соответственно величин X и Y. Подставляя выражение (8.6.10) в формулу (8.6.9), видим, что интеграл (8.6.9) превращается в произведение двух интегралов:

— плотности распределения соответственно величин X и Y. Подставляя выражение (8.6.10) в формулу (8.6.9), видим, что интеграл (8.6.9) превращается в произведение двух интегралов:

Интеграл

представляет собой не что иное, как первый центральный момент величины X, и, следовательно, равен нулю; по той же причине равен пулю и второй сомножитель; следовательно, для независимых случайных величин  = 0.

= 0.

Таким образом, если корреляционный момент двух случайных величин отличен от нуля, это есть признак наличия зависимости между ними.

Из формулы (8.6.7) видно, что корреляционный момент характеризует не только зависимость величин, но и их рассеивание. Действительно, если, например, одна из величин (X, Y) весьма мало отклоняется от своего математического ожидания (почти не случайна),

Для прерывных оно может быть выполнено аналогичным способом.

Для прерывных оно может быть выполнено аналогичным способом.

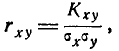

то корреляционный момент будет мал, какой бы тесной зависимостью ни были связаны величины (X,Y ). Поэтому для характеристики связи между величинами (X, Y) в чистом виде переходят от момента  к безразмерной характеристике

к безразмерной характеристике  (8.6.11)

(8.6.11)

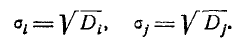

где  —средние квадратические отклонения величин X, Y. Эта характеристика называется коэффициентом корреляции величин X и Y. Очевидно, коэффициент корреляции обращается в нуль одновременно с корреляционным моментом; следовательно, для независимых случайных величин коэффициент корреляции равен нулю.

—средние квадратические отклонения величин X, Y. Эта характеристика называется коэффициентом корреляции величин X и Y. Очевидно, коэффициент корреляции обращается в нуль одновременно с корреляционным моментом; следовательно, для независимых случайных величин коэффициент корреляции равен нулю.

Случайные величины, для которых корреляционный момент (а значит, и коэффициент корреляции) равен нулю, называются некоррелированными (иногда — «несвязанными»).

Выясним, эквивалентно ли понятие некоррелированности случайных величин понятию независимости. Выше мы доказали, что две независимые случайные величины всегда являются некоррелированными. Остаётся выяснить: справедливо ли обратное положение, вытекает ли из некоррелированности величин их независимость? Оказывается — нет. Можно построить примеры таких случайных величин, которые являются некоррелированными, но зависимыми. Равенство нулю коэффициента корреляции — необходимое, но не достаточное условие независимости случайных величин. Из независимости случайных величин вытекает их некоррелированность; напротив, из некоррелированности величин ещё не следует их независимость. Условие независимости случайных величин — более жёсткое, чем условие некоррелированности.

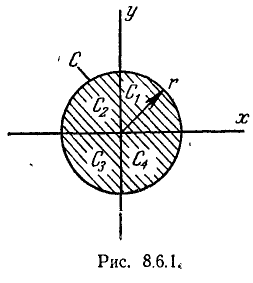

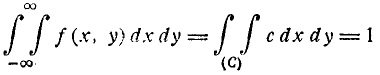

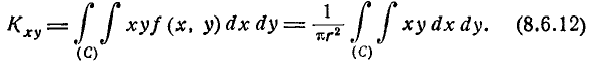

Убедимся с этом на примере. Рассмотрим систему случайных величин (X, Y), распределённую с равномерной плотностью внутри круга С радиуса г с центром в начале координат (рис. 8.6.1).

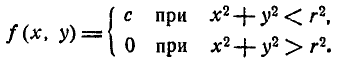

Плотность распределения величин (X, Y) выражается формулой

Из условия  находим

находим

Нетрудно убедиться, что в данном примере величины являются зависимыми. Действительно, непосредственно ясно, что если величина X приняла, например, значение 0, то величина Y может с равной вероятностью принимать все значения от — r до +r; если же величина X приняла значение r, то величина Y может при- принять только одно-единственное значение, в точности равное нулю; вообще, диапазон возможных значений Y зависит от того, какое значение приняла X.

Посмотрим, являются ли эти величины коррелированными. Вычислим корреляционный момент. Имея в виду, что по cображениям симметрии получим,

получим,

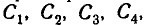

Для вычисления интеграла разобьём область интегрирования (круг С) на четыре сектора  соответствующие четырём координатным углам. В секторах

соответствующие четырём координатным углам. В секторах  и

и  подынтегральная функция положительна, в секторах

подынтегральная функция положительна, в секторах  и

и  — отрицательна; по абсолютной же величине интегралы по этим секторам равны; следовательно, интеграл (8.6.12) равен нулю, и величины (Х,Y)

— отрицательна; по абсолютной же величине интегралы по этим секторам равны; следовательно, интеграл (8.6.12) равен нулю, и величины (Х,Y)

Таким образом, мы видим, что из некоррелированности случайных величин не всегда следует их независимость.

Коэффициент корреляции характеризует не всякую зависимость, а только так называемую линейную зависимость. Линейная вероятностная зависимость случайных величин заключается в том, что при возрастании одной случайной величины другая имеет тенденцию возрастать (или же убывать) по линейному закону. Эта тенденция к линейной зависимости может быть более или менее ярко выраженной, более или менее приближаться к функциональной, т. е. самой тесной линейной зависимости. Коэффициент корреляции характеризует степень тесноты линейной зависимости между случайными величинами. Если случайные величины X и У связаны точной линейной функциональной зависимостью:

то  причём знак «плюс» или «минус» берётся в зависимости от того, положителен или отрицателен коэффициент а. В общем случае, когда величины X и К связаны произвольной вероятностной зависимостью, коэффициент корреляции может иметь значение в пределах:

причём знак «плюс» или «минус» берётся в зависимости от того, положителен или отрицателен коэффициент а. В общем случае, когда величины X и К связаны произвольной вероятностной зависимостью, коэффициент корреляции может иметь значение в пределах:

Доказательство этих положений будет дано ниже, в п° 10.3, после того как мы познакомимся с некоторыми теоремами теории вероятностей, которые позволят провести его очень просто.

Доказательство этих положений будет дано ниже, в п° 10.3, после того как мы познакомимся с некоторыми теоремами теории вероятностей, которые позволят провести его очень просто.

В случае  говорят о положительной корреляции вели- величин Х и Y, в случае

говорят о положительной корреляции вели- величин Х и Y, в случае  — об отрицательной корреляции. Положительная корреляция между случайными величинами означает, что при возрастании одной из них другая имеет тенденцию в среднем возрастать; отрицательная корреляция означает, что при возрастании одной из случайных величин- другая имеет тенденцию в среднем убывать.

— об отрицательной корреляции. Положительная корреляция между случайными величинами означает, что при возрастании одной из них другая имеет тенденцию в среднем возрастать; отрицательная корреляция означает, что при возрастании одной из случайных величин- другая имеет тенденцию в среднем убывать.

В рассмотренном примере двух случайных величин (X, У), распределённых внутри круга с равномерной плотностью, несмотря на наличие зависимости между X и К, линейная зависимость отсутствует; при возрастании X меняется только диапазон изменения Y,

а его среднее значение не меняется; естественно, величины (X, Y) оказываются некоррелированными.

Приведем несколько примеров случайных величин с положительной и отрицательной корреляцией.

- Вес и рост человека связаны положительной корреляцией.

- Время,. потраченное на регулировку прибора при подготовке его к работе, и время его безотказной работы связаны положительной корреляцией (если, разумеется, время потрачено разумно). Наоборот, время, потраченное на подготовку, и количество неисправностей, обнаруженное при работе прибора, связаны отрицательной корреляцией.

- При стрельбе залпом координаты точек попадания отдельных снарядов- связаны положительной корреляцией (так как имеются общие для всех выстрелов ошибки прицеливания, одинаково отклоняющие от цели каждый из них).

- Производится два выстрела по цели; точка попадания первого выстрела регистрируется, и в прицел вводится поправка, пропорциональная ошибке первого выстрела с обратным знаком. Координаты точек попадания первого и второго выстрелов будут связаны отрицательной корреляцией.

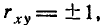

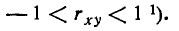

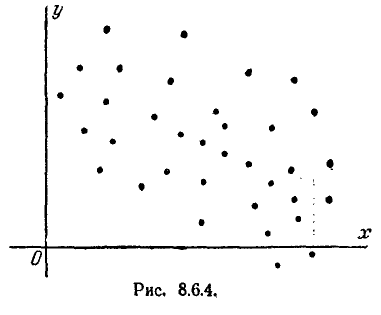

Если в нашем распоряжении имеются результаты ряда опытов над системой двух случайных величин (X, У), то о наличии или отсутствии существенной корреляции между ними легко судить в первом приближении по графику, на котором изображены в виде точек все полученные из опыта пары значений случайных величин. Например, если наблюдённые пары значений величин расположились так, как показано на рис. 8.6.2, то это указывает на ‘наличие явно выраженной положительной корреляции между величинами. Ещё более ярко выраженную положительную корреляцию, близкую к линейной функциональной зависимости, наблюдаем на рис. 8.6.3. На рис. 8.6.4 показан случай сравнительно слабой отрицательной корреляции.

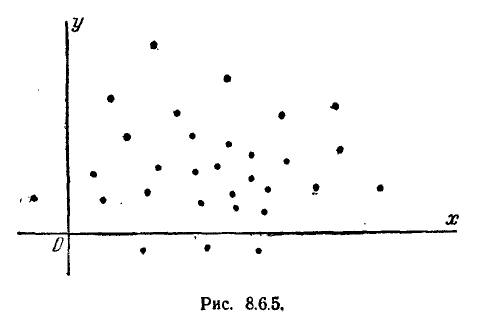

Наконец, на рис. 8.6.5 иллюстрируется случай практически некоррелированных случайных величин. На практике, перед тем как исследовать корреляцию случайных величин, всегда полезно предварительно построить наблюдённые пары значений на графике для первого качественного суждения о типе корреляции.

Способы определения характеристик системы случайных величин из опыта будут освещены в гл. 14.

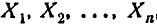

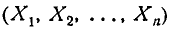

Система произвольного числа случайных величин

На практике часто приходится рассматривать системы более чем двух случайных величин. Эти системы интерпретируются как случайные точки или случайные векторы в пространстве того или иного числа измерений.

Приведем примеры.

- Точка разрыва дистанционного снаряда в пространстве характеризуется тремя декартовыми координатами (X, У, Z) или тремя сферическими координатами

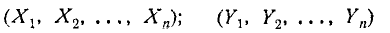

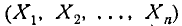

- Совокупность п последовательных измерений изменяющейся величины X — система п случайных величин

- Производится стрельба очередью из п снарядов. Совокупность координат п точек попадания на плоскости — система 2n случайных величин (абсцисс и ординат точек попадания):

- Начальная скорость осколка — случайный вектор, характеризуемый тремя случайными величинами: величиной скорости

и двумя углами Ф и

и двумя углами Ф и  , определяющими направление полёта осколка в сферической системе координат.

, определяющими направление полёта осколка в сферической системе координат.

Полной характеристикой системы произвольного числа случайных величин служит закон распределения системы, который может быть задан функцией распределения или плотностью распределения.

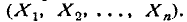

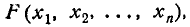

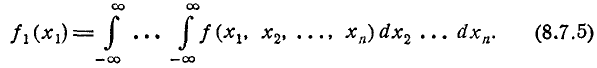

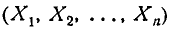

Функцией распределения системы п случайных величин  называется вероятность совместного выполнения п неравенств вида

называется вероятность совместного выполнения п неравенств вида

Плотностью распределения системы п непрерывных случайных величин называется n-я смешанная частная производная функции  , взятая один раз по каждому аргументу:

, взятая один раз по каждому аргументу:

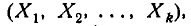

Зная закон распределения системы, можно определить законы распределения отдельных величин, входящих в систему. Функция распределения каждой из величин, входящих в систему, получится, если в функции распределения системы положить все остальные аргументы равными

Если выделить из системы величин  частную систему

частную систему  то функция распределения этой системы определяется по формуле

то функция распределения этой системы определяется по формуле

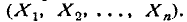

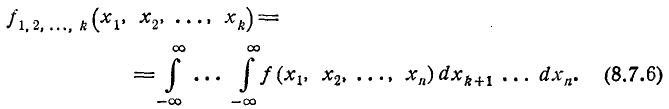

Плотность распределения каждой из величин, входящих в систему, получится, если плотность распределения системы проинтегрировать в бесконечных пределах по всем остальным аргументам:

Плотность распределения частной системы  выделенной из системы

выделенной из системы  , равна:

, равна:

Условным законом распределения частной системы  называется её закон распределения, вычисленный при условии, что остальные величины

называется её закон распределения, вычисленный при условии, что остальные величины  приняли значения

приняли значения

Условная плотность распределения может быть вычислена по формуле

Случайные величины  называются независимыми, если закон распределения каждой частной системы, выделенной из системы

называются независимыми, если закон распределения каждой частной системы, выделенной из системы  , не зависит от того, какие значения при- приняли остальные случайные величины.

, не зависит от того, какие значения при- приняли остальные случайные величины.

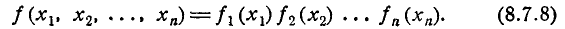

Плотность распределения системы независимых случайных величин равна произведению плотностей распределения отдельных величин, входящих в систему:

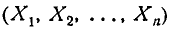

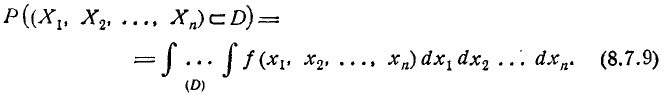

Вероятность попадания случайной точки  в пределы n-мерной области D выражается n-кратным интегралом:

в пределы n-мерной области D выражается n-кратным интегралом:

Формула (8.7.9) по существу является основной формулой для вычисления вероятностей событий, не сводящихся к схеме случаев. Действительно, если интересующее нас событие А не сводится к схеме случаев, то его вероятность не может быть вычислена непосредственно. Если при этом нет возможности поставить достаточное число однородных опытов и приближённо определить вероятность события А по его частоте, то типичная схема вычисления вероятности события сводится к следующему. Переходят от схемы событий к схеме случайных величин (чаще всего — непрерывных) и сводят событие А к событию, состоящему в том, что система случайных величин  окажется в пределах некоторой области D. Тогда вероятность события А может быть вычислена по формуле (8.7.9).

окажется в пределах некоторой области D. Тогда вероятность события А может быть вычислена по формуле (8.7.9).

Пример:

Самолёт поражается дистанционным снарядом при условии, если разрыв снаряда произошёл не далее чем на расстоянии R от самолёта (точнее, от условной точки на оси самолёта, принимаемой за его центр). Закон распределения точек разрыва дистанционного снаряда в системе координат, связанной с целью, имеет плотность f (х, у, r). Определить вероятность поражения самолёта.

Решение:

Обозначая поражение самолёта буквой А, имеем:

где интегрирование распространяется по шару С радиуса R с центром в начале координат.

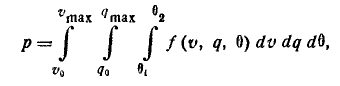

Пример:

Метеорит, встретившийся на пути искусственного спутника Земли, пробивает его оболочку, если: 1) угол в, под которым метеорит встречается с поверхностью спутника, заключён в определённых пределах 2) метеорит имеет вес не менее

2) метеорит имеет вес не менее  (r) и 3) относительная скорость встречи метеорита со спутником не меньше

(r) и 3) относительная скорость встречи метеорита со спутником не меньше  (м/сек). Скорость встречи v, вес метеорита q и угол встречи

(м/сек). Скорость встречи v, вес метеорита q и угол встречи  представляют собой систему случайных величин с плотностью распределения

представляют собой систему случайных величин с плотностью распределения  . Найти вероятность р того, что отдельный метеорит, попавший в спутник, пробьёт его оболочку.

. Найти вероятность р того, что отдельный метеорит, попавший в спутник, пробьёт его оболочку.

Решение:

Интегрируя плотность распределения  по трёхмерной области, соответствующей пробиванию оболочки,

по трёхмерной области, соответствующей пробиванию оболочки,

где  — максимальный вес метеорита,

— максимальный вес метеорита,  — максимальная скорость встречи.

— максимальная скорость встречи.

Числовые характеристики системы нескольких случайных величин

Закон распределения системы (заданный функцией распределения или плотностью распределения) является полной, исчерпывающей характеристикой системы нескольких случайных величин. Однако очень часто такая исчерпывающая характеристика не может быть применена. Иногда ограниченность экспериментального материала не даёт возможности построить закон распределения системы. В других случаях исследование вопроса с помощью сравнительно громоздкого аппарата законов распределения не оправдывает себя в связи с невысокими требованиями к точности результата. Наконец, в ряде задач примерный тип закона распределения (нормальный закон) известен заранее и требуется только найти его характеристики.

Во всех таких случаях вместо законов распределения применяют неполное, приближенное описание системы случайных величин с помощью минимального количества числовых характеристик.

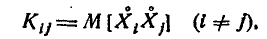

Минимальное число характеристик, с помощью которых может быть охарактеризована система n случайных величин  , сводится к следующему:

, сводится к следующему:

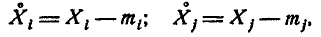

1) п математических ожиданий  характеризующих средние значения величин; 2) п дисперсий

характеризующих средние значения величин; 2) п дисперсий  характеризующих их рассеивание; 3) п(п — 1) корреляционных моментов

характеризующих их рассеивание; 3) п(п — 1) корреляционных моментов

где

характеризующих попарную корреляцию всех величин, входящих в систему.

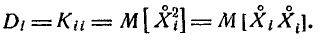

Заметим, что дисперсия каждой из случайных величин  есть, по существу, не что иное, как частный случай корреляционного момента, а именно корреляционный момент величины

есть, по существу, не что иное, как частный случай корреляционного момента, а именно корреляционный момент величины  и той же величины

и той же величины

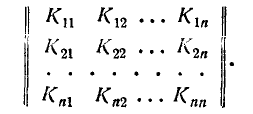

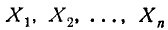

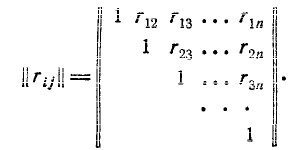

Все корреляционные моменты и дисперсии удобно расположить в виде прямоугольной таблицы (так называемой матрицы):

Эта таблица называется корреляционной матрицей системы случайных величин

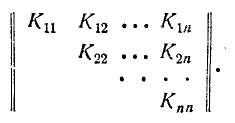

Очевидно, что не все члены .корреляционной матрицы различны. Из определения корреляционного момента ясно, что  т. е. элементы корреляционной матрицы, расположенные симметрично по отношению к главной диагонали, равны. В связи с этим часто заполняется не вся корреляционная матрица, а лишь её половина, считая от главной диагонали:

т. е. элементы корреляционной матрицы, расположенные симметрично по отношению к главной диагонали, равны. В связи с этим часто заполняется не вся корреляционная матрица, а лишь её половина, считая от главной диагонали:

Корреляционную матрицу, составленную из элементов  часто сокращённо обозначают символом

часто сокращённо обозначают символом  .

.

По главной диагонали корреляционной матрицы стоят дисперсии случайных величин  .

.

В случае, когда случайные величины  не коррелированы, все элементы корреляционной матрицы кроме диагональных, равны нулю:

не коррелированы, все элементы корреляционной матрицы кроме диагональных, равны нулю:

Такая матрица называется диагональной.

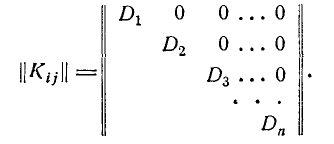

В целях наглядности суждения именно о коррелированности случайных величин безотносительно к их рассеиванию часто вместо корреляционной матрицы  пользуются нормированной корреляционной матрицей

пользуются нормированной корреляционной матрицей , составленной не из корреляционных моментов, а из коэффициентов корреляции:

, составленной не из корреляционных моментов, а из коэффициентов корреляции:

где

Все диагональные элементы этой матрицы, естественно, равны единице. Нормированная корреляционная матрица имеет вид:

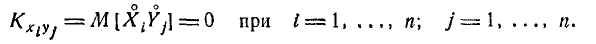

Введём понятие о некоррелированных системах случайных величин (иначе — о некоррелированных случайных векторах). Рассмотрим две системы случайных величин:

или два случайных вектора в n-мерном пространстве:  с составляю- составляющими

с составляю- составляющими и

и  с составляющими

с составляющими  Случайные векторы

Случайные векторы  и

и  называются некоррелированными, если каждая из составляющих вектора

называются некоррелированными, если каждая из составляющих вектора  не коррелирована с каждой из составляющих вектора

не коррелирована с каждой из составляющих вектора  :

:

Решение заданий и задач по предметам:

Дополнительные лекции по теории вероятностей:

- Случайные события и их вероятности

- Случайные величины

- Функции случайных величин

- Числовые характеристики случайных величин

- Законы больших чисел

- Статистические оценки

- Статистическая проверка гипотез

- Статистическое исследование зависимостей

- Теории игр

- Вероятность события

- Теорема умножения вероятностей

- Формула полной вероятности

- Теорема о повторении опытов

- Нормальный закон распределения

- Определение законов распределения случайных величин на основе опытных данных

- Нормальный закон распределения для системы случайных величин

- Вероятностное пространство

- Классическое определение вероятности

- Геометрическая вероятность

- Условная вероятность

- Схема Бернулли

- Многомерные случайные величины

- Предельные теоремы теории вероятностей

- Оценки неизвестных параметров

- Генеральная совокупность